Solo l'11% delle banche ha un'AI davvero affidabile. Il resto naviga a vista

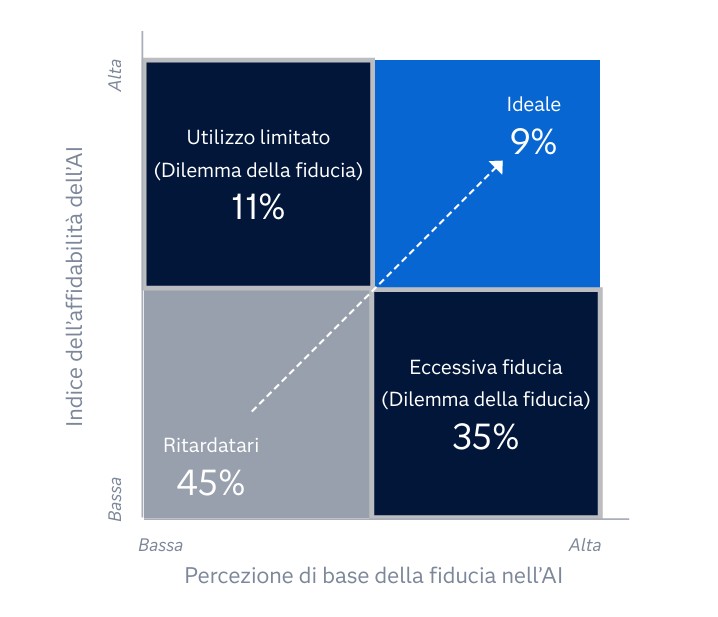

Il 47% delle banche opera nel dilemma della fiducia: sistemi AI senza governance adeguata o strumenti maturi ignorati. Solo l'11% ha raggiunto l'allineamento ottimale.

Il settore bancario sta adottando l'AI più velocemente degli altri, spendendo di più e con obiettivi ambiziosi. Eppure, quasi la metà delle banche globali opera in quello che si definisce "dilemma della fiducia": sistemi di AI implementati senza un'adeguata infrastruttura di governance, oppure strumenti già maturi lasciati inutilizzati perché l'azienda non si fida abbastanza. Solo l'11% degli istituti ha raggiunto l'allineamento ottimale tra fiducia interna nei sistemi e affidabilità dimostrabile degli stessi. Il 47% naviga in acque inesplorate.

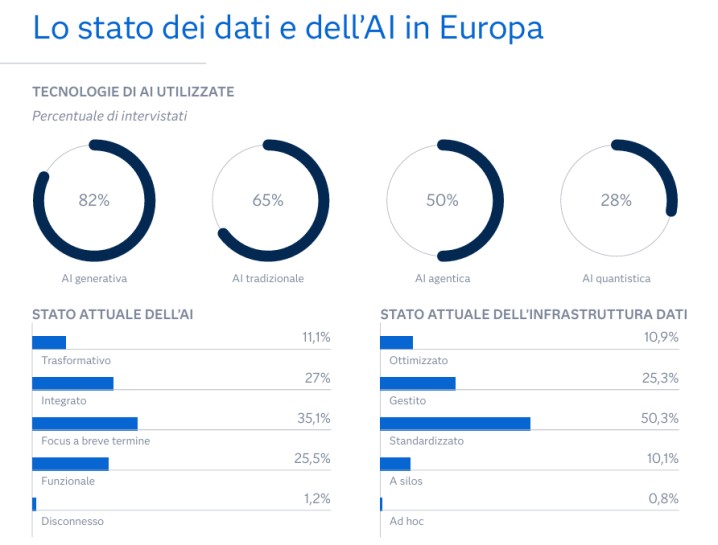

Questi sono i dati centrali del Data and AI Impact Report: The Trust Imperative di SAS, una ricerca globale condotta da IDC intervistando 2.375 leader IT e business su un campione cross-industry che comprende banche, assicurazioni, life science e pubblica amministrazione. I numeri del banking sono i più eclatanti del report perché il settore appare come il più avanzato, ponendosi come apripista per l’adozione di pratiche di AI affidabile, con circa il 23% degli istituti che si colloca al livello più alto del Trustworthy AI Index di IDC. Il problema è che nove banche su 10 non hanno ancora allineato fiducia e risultati concreti.

Partecipa agli ItalianSecurityAwards 2026 ed esprimi il tuo voto premiando le soluzioni di cybersecurity che reputi più innovative

Il paradosso emerge dai dati sugli investimenti: nei prossimi mesi il 60% delle banche prevede aumenti di spesa in AI compresi tra il 4% e il 20%; un ulteriore 12% si aspetta incrementi ancora più marcati. Il settore cresce più in fretta di tutti gli altri inclusi nella ricerca. Purtroppo, questa accelerazione non è accompagnata da un rafforzamento proporzionale delle infrastrutture che rendono l'AI affidabile: quasi una banca su cinque (19%) opera ancora con architetture dati divise in silos, la percentuale peggiore tra tutti i verticali analizzati. Il 45% dichiara l'assenza di una data governance efficace; il 41% non dispone di un'infrastruttura dati centralizzata o ottimizzata. Il 42% segnala carenza di competenze specialistiche in ambito AI.

La spiegazione sta in una dinamica ben nota a chi osserva il settore IT da anni: la pressione a innovare arriva prima che siano mature le condizioni per farlo in sicurezza. Nel caso delle banche, questa dinamica è amplificata da due spinte: da un lato, la concorrenza delle fintech e delle big tech che erogano servizi finanziari costringe gli istituti tradizionali ad accelerare l'adozione dell'AI per non perdere quote di mercato. Il secondo stimolo viene dalla pressione regolamentare, che crea l'apparenza di un presidio solido convincendo i decisori che operare in un settore normato equivalga automaticamente a operare con sistemi affidabili. Non è così.

Il dilemma della fiducia

Il concetto di dilemma della fiducia introdotto dal report merita un approfondimento, perché non si tratta di un problema psicologico o comunicativo. IDC distingue due dimensioni che non sempre coincidono: la fiducia percepita nell'AI, ossia quanto i decision maker credono nel sistema, e l'affidabilità effettiva, ovvero quanto il sistema è costruito e governato in modo da giustificare quella fiducia. A livello globale, solo il 9% delle organizzazioni ha raggiunto l'allineamento tra le due. Il 35% esprime un’alta fiducia percepita, a fronte di una bassa affidabilità reale. Questo è il rischio operativo più serio perché porta le aziende a fidarsi di sistemi di cui non dovrebbero.

Per le banche, il profilo è ancora più critico: il 47% degli istituti si distribuisce tra i due quadranti del dilemma, con una concentrazione nel quadrante dell'eccessiva fiducia. In pratica, quasi metà del settore sta prendendo decisioni di credito, gestione del rischio, antiriciclaggio, customer scoring basandosi su sistemi AI che non hanno ancora raggiunto standard di governance adeguati. Non perché le banche siano negligenti per cultura, ma perché la velocità di adozione ha sistematicamente preceduto la costruzione delle fondamenta.

Una banca che utilizza un modello AI per valutare l'affidabilità creditizia di un cliente, per decidere se segnalare una transazione come sospetta o se proporre un prodotto finanziario personalizzato, di fatto sta delegando a un sistema automatizzato decisioni che hanno impatti diretti sulla vita delle persone. Quando quel sistema sbaglia, le conseguenze non sono un bug in un'applicazione di intrattenimento: sono un credito negato ingiustamente, un conto bloccato per un falso positivo, un cliente profilato in modo discriminatorio.

Per questo la fiducia nell'AI bancaria dovrebbe richiedere molto più di una validazione tecnica interna. Richiede spiegabilità, ossia la capacità di motivare ogni output del modello in termini comprensibili per i tecnici come per i regolatori e, nei casi in cui la legge lo impone, per i clienti stessi. Richiede trasparenza sui dati di addestramento per escludere bias strutturali che si trasmettono dai dati storici ai modelli predittivi. Richiede processi di audit continui, non solo al momento della messa in produzione. E richiede una governance formale che assegni responsabilità precise su ogni aspetto del ciclo di vita del sistema AI.

La difficoltà di questa costruzione non è esclusiva del settore bancario, né riguarda solo chi l'AI la usa. Riguarda anche chi la sviluppa. Il recente caso della fuga di dati da Claude Code, lo strumento di sviluppo agentivo di Anthropic, ha mostrato che le vulnerabilità di governance AI colpiscono vendor di primissimo piano con investimenti ingenti in sicurezza e in AI responsabile. Se chi costruisce i modelli fatica a blindare i propri ambienti di sviluppo, è lecito chiedersi con quale grado di maturità le organizzazioni che li adottano stiano gestendo i rischi derivanti dall'integrazione di questi strumenti nei propri processi critici. Non è una domanda retorica: è esattamente il tipo di valutazione che ogni banca dovrebbe fare prima di espandere il perimetro di autonomia dei propri sistemi AI.

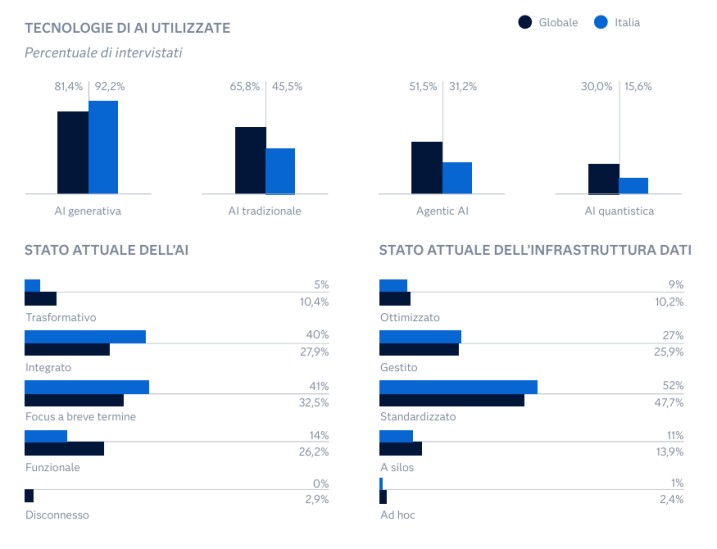

L'Italia: il talento manca più della tecnologia

Nel contesto europeo, l'Italia si colloca in una posizione di medio ritardo sia sull'indice di affidabilità AI (2,73 su 5, tra i valori più bassi del continente) che sull'impatto dichiarato (3,01). La lettura comparata con i paesi che performano meglio, Irlanda in testa, indica che le organizzazioni italiane mostrano una base dati relativamente solida, con punti di forza ai livelli "standardizzato" e "gestito", e una quota di aziende con silos non integrati (11%) inferiore alla media globale (13,9%). Il nostro problema è il capitale umano. La carenza di personale qualificato in ambito AI viene segnalata con un'incidenza superiore di 12,8 punti percentuali rispetto alla media globale: è il primo ostacolo all'implementazione, staccato nettamente da tutti gli altri. Il limitato supporto del management (gap +4%), l'assenza di dipendenti con competenze specifiche (+1%) e la scarsa attenzione all'uso etico e all'equità dei sistemi (-5%) completano un quadro in cui i progressi dipendono più dalla capacità organizzativa che dalle risorse tecniche. Pesa anche il contesto normativo: le restrizioni sul processo decisionale automatizzato (+14%) e gli obblighi di localizzazione dei dati (+17,5%), sommati alla carenza di competenze, rendono la costruzione di sistemi AI scalabili un percorso oggettivamente più tortuoso che altrove.

Il ritorno d’investimento

Uno degli elementi più intriganti del report riguarda la logica economica dell'AI nel banking. Molti si aspettano che a guidare il successo dell’AI sia il taglio dei costi: automazione dei processi ripetitivi, riduzione del personale amministrativo, maggiore efficienza operativa. Il banking è l'unico settore tra quelli analizzati a indicare l'innovazione di prodotti e servizi come prima leva di valore dell'AI.

L'analisi cross-industry sul ritorno dell'investimento rafforza questa prospettiva. Le organizzazioni che utilizzano l'AI per migliorare la customer experience registrano il ROI più alto: 1,83 dollari per ogni dollaro investito. Seguono quelle orientate all'aumento della quota di mercato, con 1,74. Le iniziative focalizzate esclusivamente sul cost saving si fermano a 1,54. La differenza non è marginale: chi punta all'esperienza del cliente ottiene quasi il 20% in più rispetto a chi insegue i tagli. E, dato ancora più significativo, le organizzazioni che hanno dato priorità alla costruzione di un'AI affidabile hanno il 60% di probabilità in più di raddoppiare il ritorno complessivo sull'investimento in AI. L'affidabilità è un acceleratore economico.

Questo cambia radicalmente il frame con cui le banche dovrebbero valutare gli investimenti in governance AI. Si tratta di inquadrare l’AI come infrastruttura abilitante per un ROI superiore. Le banche che la stanno costruendo, anche rallentando la velocità di deploy nel breve termine, si stanno posizionando per rendimenti più stabili e più alti nel medio periodo. Quelle che accelerano il deploy senza rafforzare le basi stanno ottimizzando per il breve periodo, a spese del lungo.

Il report segnala inoltre che le banche stanno spingendo più di altri settori verso l'AI agentica, con quasi un terzo degli istituti che prevede di aumentare gli investimenti in AI affidabile specificamente per supportare sistemi più autonomi. Questo dato merita attenzione, perché l'AI agentica introduce una discontinuità qualitativa rispetto all'AI generativa o predittiva.

Un sistema agentico non si limita a produrre output su richiesta: prende decisioni sequenziali, utilizza strumenti esterni, esegue azioni in ambienti reali con effetti difficilmente reversibili. In ambito bancario, un agente AI può gestire autonomamente flussi di approvazione, eseguire operazioni sui conti, interagire con sistemi di compliance in tempo reale. Le implicazioni in termini di governance non sono un'estensione lineare di quelle che valgono per i sistemi AI tradizionali: sono di ordine superiore. Ogni punto di debolezza nella catena di controllo viene amplificato dall'autonomia del sistema. Un bias in un modello predittivo produce un output sbagliato che un operatore umano può correggere; un bias in un agente autonomo può propagarsi attraverso decine di decisioni prima che qualcuno se ne accorga.

Il 52% delle banche che prevede di espandere l'architettura AI e il 43% che intende potenziare i team dedicati stanno probabilmente già guardando a questo orizzonte. Ma se il 45% opera ancora senza data governance efficace e quasi una su cinque ha ancora silos di dati non integrati, è chiaro che le condizioni per un'adozione sicura dell'AI agentica non esistono ancora per la maggioranza del settore. Costruire sistemi autonomi su basi fragili è un rischio inconsapevole.

Gli aggiustamenti necessari

I dati del report delineano abbastanza chiaramente quali siano le priorità per le banche che vogliono uscire dal dilemma della fiducia. La prima è la data governance: il 45% degli istituti che dichiara di non averne una efficace, è il numero che più di tutti indica dove il lavoro manca perché non si costruisce un'AI affidabile su dati non governati. La seconda è la dissoluzione dei silos: il 19% di banche con dati ancora frammentati è la percentuale peggiore tra tutti i settori, in un'industria che gestisce i dati più sensibili esistenti. La terza è il talento: le competenze specialistiche in AI non si acquistano con un unico ciclo di hiring; richiedono programmi strutturati di formazione interna, percorsi di riqualificazione e, in molti casi, una revisione profonda dei profili richiesti nei team di risk management e compliance. La quarta, e forse la più difficile da attuare perché richiede un cambiamento culturale, è il riconoscimento che la governance AI non è un overhead burocratico da tollerare, ma una condizione abilitante per il ROI.

Il 31% che dichiara di volersi concentrare sul tuning dei modelli invece che sull'espansione dell'architettura è il segno che una parte del settore ha già cambiato prospettiva. Il gap tra questo 31% e il restante 69% è la distanza che separa il banking da un'adozione dell'AI che sia al tempo stesso ambiziosa e solida. Colmarla richiede investimenti, tempo e, soprattutto, la consapevolezza che la fiducia nell'AI non si costruisce accelerando la messa in produzione: si costruisce prima.

Tag correlati

Esplora altri articoli su questi argomenti

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

Threat actor cinese sbarca in Europa grazie all'AI

05-06-2026

EU Tech Sovereignty Package: dal dibattito all’attuazione

05-06-2026

Ambienti OT: come calcolare il costo dei potenziali downtime

05-06-2026

Il cloud non è una scusa: la sovranità del dato resta un tema da considerare

05-06-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab