Il dilemma del riconoscimento facciale

Il riconoscimento facciale è in queste ore sul banco degli imputati. È una nuova puntata del dibattito sul bias dell'intelligenza artificiale

Articolo aggiornato

Le proteste che si sono diffuse negli Stati Uniti dopo la morte di George Floyd hanno avuto, indirettamente, riflessi importanti anche nel mondo delle tecnologie. Molto più che per i molti episodi simili purtroppo già registrati in passato. L'America tecnologica in primo luogo si è accorta che "diversity" è una parola molto citata ma poco applicata. E che il management delle grandi aziende della Silicon Valley, come quello delle aziende in generale, non è affatto "diverse". Al vertice ci sono pochissime persone di colore e pochissime donne.

Ma la presa di coscienza di cui si parla di più in questi giorni è anche un'altra. La tecnologia non può sempre arroccarsi dietro la sua classica posizione di avere un ruolo "neutro". È vero che un qualsiasi strumento può essere usato bene o male, dipende da chi lo usa. Ma se si constata - come affermano tutti i movimenti alla Black Lives Matter - che una società è sistematicamente deviata a sfavore di certe sue minoranze, questo distacco è difficilmente sostenibile. La tecnologia neutra, è l'accusa, diventa tecnologia complice.

Nel mirino sono finite in particolare le tecnologie per il riconoscimento facciale. Essenzialmente perché per la prima volta, ufficialmente, un CEO di una grande azienda - Arvind Krishna, di IBM - sottolinea che queste possono essere, e di fatto sono, usate male. E ha deciso di conseguenza di smettere - o quasi - di commercializzarle. La speranza di Krishna era probabilmente solo aprire un dibattito, non lanciare una tendenza. Ha fatto quindi altrettanto notizia che Amazon abbia sospeso l'utilizzo delle sue tecnologie per il riconoscimento facciale.

Sembra un dibattito limitato e incentrato su un settore molto specifico. Ma è probabile, e auspicabile, che si ampli. In fondo il riconoscimento facciale è solo la punta di un iceberg. Non esiste senza l'intelligenza artificiale e il machine learning. Che a loro volta non esistono senza la capacità di raccogliere ed analizzare enormi quantità di dati. Dal face recognition si passa quindi immediatamente ad alcuni dei campi principali per l'IT di questi anni.

Sembra un dibattito limitato e incentrato su un settore molto specifico. Ma è probabile, e auspicabile, che si ampli. In fondo il riconoscimento facciale è solo la punta di un iceberg. Non esiste senza l'intelligenza artificiale e il machine learning. Che a loro volta non esistono senza la capacità di raccogliere ed analizzare enormi quantità di dati. Dal face recognition si passa quindi immediatamente ad alcuni dei campi principali per l'IT di questi anni.

Ovviamente gli algoritmi di machine learning non hanno opinioni proprie. Ma se sono stati addestrati con campioni di volti in cui la "normalità" è fatta prevalentemente di bianchi e la "devianza" in maggioranza di persone di colore, assorbirà implicitamente questo punto di vista. Con rischi altissimi di identificare come criminali persone che non lo sono, semplicemente per il colore della loro pelle.

Affidarsi agli automatismi permessi dalle varie forme dell'intelligenza artificiale è comodo, in tutti i settori. Ma è anche rischioso. A maggior ragione in ambiti cruciali come l'ordine pubblico. E a ulteriore maggior ragione quando il sistema sembra "truccato", più o meno inconsciamente, a sfavore di alcuni. La ipersensibilità verso il riconoscimento facciale sta anche e soprattutto in questo. Alcuni vendor tecnologici propagandano scenari in cui basta inquadrare un gruppo di manifestanti per riconoscerli e "giudicarli" automaticamente. Se gli algoritmi sono di dubbia imparzialità, come è possibile sentirsi garantiti nei propri diritti?

Affidarsi agli automatismi permessi dalle varie forme dell'intelligenza artificiale è comodo, in tutti i settori. Ma è anche rischioso. A maggior ragione in ambiti cruciali come l'ordine pubblico. E a ulteriore maggior ragione quando il sistema sembra "truccato", più o meno inconsciamente, a sfavore di alcuni. La ipersensibilità verso il riconoscimento facciale sta anche e soprattutto in questo. Alcuni vendor tecnologici propagandano scenari in cui basta inquadrare un gruppo di manifestanti per riconoscerli e "giudicarli" automaticamente. Se gli algoritmi sono di dubbia imparzialità, come è possibile sentirsi garantiti nei propri diritti?

Per IBM in particolare l'atto ha una importante valenza. Perché IBM è IBM, un nome storico dell'IT statunitense. Perché il suo CEO attuale è di colore. Perché IBM non farà business con il riconoscimento facciale ma ha puntato moltissimo sul machine learning. Ed è questo in fondo che porta il rischio di "sorveglianza di massa, profilazione razziale, violazione delle libertà e dei diritti umani basilari". Per dirla con le parole di Arvind Krishna. Qualcosa sul piatto, insomma, IBM lo ha messo.

Per Amazon il discorso è più complesso. L'azienda di Jeff Bezos, onestamente, non è molto popolare al di fuori della cerchia dei suoi clienti. Amazon porta loro di tutto e in poche ore. Ma a pagare per questo, sostengono i critici, sono lavoratori, ambiente, piccoli produttori, negozianti. E di certo non aiuta il fatto che Amazon magari lascerà perdere per un po' il riconoscimento facciale, ma sui servizi di AWS restano basate le attività di molte aziende che offrono alle autorità servizi di face recognition, controllo, sorveglianza, analisi di dati. Una constatazione che pone l'accento su un altro aspetto del dibattito sull'eticità delle applicazioni di intelligenza artificiale.

Il punto è però che ci sono diversi nomi meno noti, ma molto più specializzati, che passano sotto il radar dello scrutinio del grande pubblico. E solo qualche volta emergono da un "anonimato tecnologico" che cercano attivamente. Il caso più noto è probabilmente quello di Palantir. Nota suo malgrado perché gli stessi dipendenti ne hanno criticato pubblicamente le attività. Portando alla ribalta anche i legami con AWS, che dà a Palantir i suoi servizi cloud.

Ma per ogni Palantir, oppure ogni PredPol, ci sono decine di altre realtà che restano ignote per i non addetti ai lavori. Come la francese Idemia. Che sta per realizzare un database biometrico di oltre 400 milioni di persone, combinando fra loro quelli di tutta l'Unione Europea. Nell'ambito dello sviluppo di un sistema biometrico continentale. Considerando che Idemia ha già realizzato sistemi simili per le autorità statunitensi, si stima che per le sue tecnologie passino i dati biometrici di quasi 800 milioni di persone.

La questione è vecchia e se l'era posta Giovenale quasi duemila anni fa. È suo il citatissimo Quis custodiet ipsos custodes? Chi sorveglierà i sorveglianti? Alla fine il compito è demandato sempre all'opinione pubblica. Che però deve essere informata. E che nel caso delle tecnologie meno "ovvie" comprende in prima linea gli esperti di settore e anche chi le tecnologie le studia e le sviluppa. Che deve sempre porsi qualche legittimo dubbio sul loro utilizzo.

La questione è vecchia e se l'era posta Giovenale quasi duemila anni fa. È suo il citatissimo Quis custodiet ipsos custodes? Chi sorveglierà i sorveglianti? Alla fine il compito è demandato sempre all'opinione pubblica. Che però deve essere informata. E che nel caso delle tecnologie meno "ovvie" comprende in prima linea gli esperti di settore e anche chi le tecnologie le studia e le sviluppa. Che deve sempre porsi qualche legittimo dubbio sul loro utilizzo.

Le proteste che si sono diffuse negli Stati Uniti dopo la morte di George Floyd hanno avuto, indirettamente, riflessi importanti anche nel mondo delle tecnologie. Molto più che per i molti episodi simili purtroppo già registrati in passato. L'America tecnologica in primo luogo si è accorta che "diversity" è una parola molto citata ma poco applicata. E che il management delle grandi aziende della Silicon Valley, come quello delle aziende in generale, non è affatto "diverse". Al vertice ci sono pochissime persone di colore e pochissime donne.

Ma la presa di coscienza di cui si parla di più in questi giorni è anche un'altra. La tecnologia non può sempre arroccarsi dietro la sua classica posizione di avere un ruolo "neutro". È vero che un qualsiasi strumento può essere usato bene o male, dipende da chi lo usa. Ma se si constata - come affermano tutti i movimenti alla Black Lives Matter - che una società è sistematicamente deviata a sfavore di certe sue minoranze, questo distacco è difficilmente sostenibile. La tecnologia neutra, è l'accusa, diventa tecnologia complice.

Nel mirino sono finite in particolare le tecnologie per il riconoscimento facciale. Essenzialmente perché per la prima volta, ufficialmente, un CEO di una grande azienda - Arvind Krishna, di IBM - sottolinea che queste possono essere, e di fatto sono, usate male. E ha deciso di conseguenza di smettere - o quasi - di commercializzarle. La speranza di Krishna era probabilmente solo aprire un dibattito, non lanciare una tendenza. Ha fatto quindi altrettanto notizia che Amazon abbia sospeso l'utilizzo delle sue tecnologie per il riconoscimento facciale.

Sembra un dibattito limitato e incentrato su un settore molto specifico. Ma è probabile, e auspicabile, che si ampli. In fondo il riconoscimento facciale è solo la punta di un iceberg. Non esiste senza l'intelligenza artificiale e il machine learning. Che a loro volta non esistono senza la capacità di raccogliere ed analizzare enormi quantità di dati. Dal face recognition si passa quindi immediatamente ad alcuni dei campi principali per l'IT di questi anni.

Sembra un dibattito limitato e incentrato su un settore molto specifico. Ma è probabile, e auspicabile, che si ampli. In fondo il riconoscimento facciale è solo la punta di un iceberg. Non esiste senza l'intelligenza artificiale e il machine learning. Che a loro volta non esistono senza la capacità di raccogliere ed analizzare enormi quantità di dati. Dal face recognition si passa quindi immediatamente ad alcuni dei campi principali per l'IT di questi anni.Riconoscimento facciale: un tema delicato

Le tecnologie per il riconoscimento facciale sono sempre state un argomento spinoso. E non solo per questioni legate alla privacy delle persone che possono, eventualmente, essere individuate in una immagine. È che l'efficacia del riconoscimento facciale dipende, come ogni applicazione del machine learning, dal campione con cui sono stati addestrati i suoi algoritmi. E in diversi casi si è dimostrato il "razzismo" dei sistemi di face recognition.Ovviamente gli algoritmi di machine learning non hanno opinioni proprie. Ma se sono stati addestrati con campioni di volti in cui la "normalità" è fatta prevalentemente di bianchi e la "devianza" in maggioranza di persone di colore, assorbirà implicitamente questo punto di vista. Con rischi altissimi di identificare come criminali persone che non lo sono, semplicemente per il colore della loro pelle.

Affidarsi agli automatismi permessi dalle varie forme dell'intelligenza artificiale è comodo, in tutti i settori. Ma è anche rischioso. A maggior ragione in ambiti cruciali come l'ordine pubblico. E a ulteriore maggior ragione quando il sistema sembra "truccato", più o meno inconsciamente, a sfavore di alcuni. La ipersensibilità verso il riconoscimento facciale sta anche e soprattutto in questo. Alcuni vendor tecnologici propagandano scenari in cui basta inquadrare un gruppo di manifestanti per riconoscerli e "giudicarli" automaticamente. Se gli algoritmi sono di dubbia imparzialità, come è possibile sentirsi garantiti nei propri diritti?

Affidarsi agli automatismi permessi dalle varie forme dell'intelligenza artificiale è comodo, in tutti i settori. Ma è anche rischioso. A maggior ragione in ambiti cruciali come l'ordine pubblico. E a ulteriore maggior ragione quando il sistema sembra "truccato", più o meno inconsciamente, a sfavore di alcuni. La ipersensibilità verso il riconoscimento facciale sta anche e soprattutto in questo. Alcuni vendor tecnologici propagandano scenari in cui basta inquadrare un gruppo di manifestanti per riconoscerli e "giudicarli" automaticamente. Se gli algoritmi sono di dubbia imparzialità, come è possibile sentirsi garantiti nei propri diritti?Atti simbolici o azioni concrete?

Sono concrete o solo simboliche le posizioni prese da IBM ed Amazon? I critici hanno subito sottolineato come per entrambe le società il business legato al riconoscimento facciale sia minimo. Se ragioniamo in fatturato perso, nessuna delle due rinunce cambia qualcosa. Specialmente quella di Amazon, che è una rinuncia temporanea - un anno - in attesa di decisioni da parte del Congresso USA. Ma c'è un valore simbolico che non va trascurato.Per IBM in particolare l'atto ha una importante valenza. Perché IBM è IBM, un nome storico dell'IT statunitense. Perché il suo CEO attuale è di colore. Perché IBM non farà business con il riconoscimento facciale ma ha puntato moltissimo sul machine learning. Ed è questo in fondo che porta il rischio di "sorveglianza di massa, profilazione razziale, violazione delle libertà e dei diritti umani basilari". Per dirla con le parole di Arvind Krishna. Qualcosa sul piatto, insomma, IBM lo ha messo.

Per Amazon il discorso è più complesso. L'azienda di Jeff Bezos, onestamente, non è molto popolare al di fuori della cerchia dei suoi clienti. Amazon porta loro di tutto e in poche ore. Ma a pagare per questo, sostengono i critici, sono lavoratori, ambiente, piccoli produttori, negozianti. E di certo non aiuta il fatto che Amazon magari lascerà perdere per un po' il riconoscimento facciale, ma sui servizi di AWS restano basate le attività di molte aziende che offrono alle autorità servizi di face recognition, controllo, sorveglianza, analisi di dati. Una constatazione che pone l'accento su un altro aspetto del dibattito sull'eticità delle applicazioni di intelligenza artificiale.

Non solo nomi noti

È facile puntare il dito contro i grandi nomi dell'IT. E di certo molti di loro forniscono tecnologie per miliardi di dollari anche a realtà il cui operato è discutibile. Tutti i grandi hyperscaler possono essere messi sotto accusa, da questo punto di vista. Microsoft, AWS, Google lo sono stati più volte.Il punto è però che ci sono diversi nomi meno noti, ma molto più specializzati, che passano sotto il radar dello scrutinio del grande pubblico. E solo qualche volta emergono da un "anonimato tecnologico" che cercano attivamente. Il caso più noto è probabilmente quello di Palantir. Nota suo malgrado perché gli stessi dipendenti ne hanno criticato pubblicamente le attività. Portando alla ribalta anche i legami con AWS, che dà a Palantir i suoi servizi cloud.

Ma per ogni Palantir, oppure ogni PredPol, ci sono decine di altre realtà che restano ignote per i non addetti ai lavori. Come la francese Idemia. Che sta per realizzare un database biometrico di oltre 400 milioni di persone, combinando fra loro quelli di tutta l'Unione Europea. Nell'ambito dello sviluppo di un sistema biometrico continentale. Considerando che Idemia ha già realizzato sistemi simili per le autorità statunitensi, si stima che per le sue tecnologie passino i dati biometrici di quasi 800 milioni di persone.

La questione è vecchia e se l'era posta Giovenale quasi duemila anni fa. È suo il citatissimo Quis custodiet ipsos custodes? Chi sorveglierà i sorveglianti? Alla fine il compito è demandato sempre all'opinione pubblica. Che però deve essere informata. E che nel caso delle tecnologie meno "ovvie" comprende in prima linea gli esperti di settore e anche chi le tecnologie le studia e le sviluppa. Che deve sempre porsi qualche legittimo dubbio sul loro utilizzo.

La questione è vecchia e se l'era posta Giovenale quasi duemila anni fa. È suo il citatissimo Quis custodiet ipsos custodes? Chi sorveglierà i sorveglianti? Alla fine il compito è demandato sempre all'opinione pubblica. Che però deve essere informata. E che nel caso delle tecnologie meno "ovvie" comprende in prima linea gli esperti di settore e anche chi le tecnologie le studia e le sviluppa. Che deve sempre porsi qualche legittimo dubbio sul loro utilizzo.

Aggiornamenti

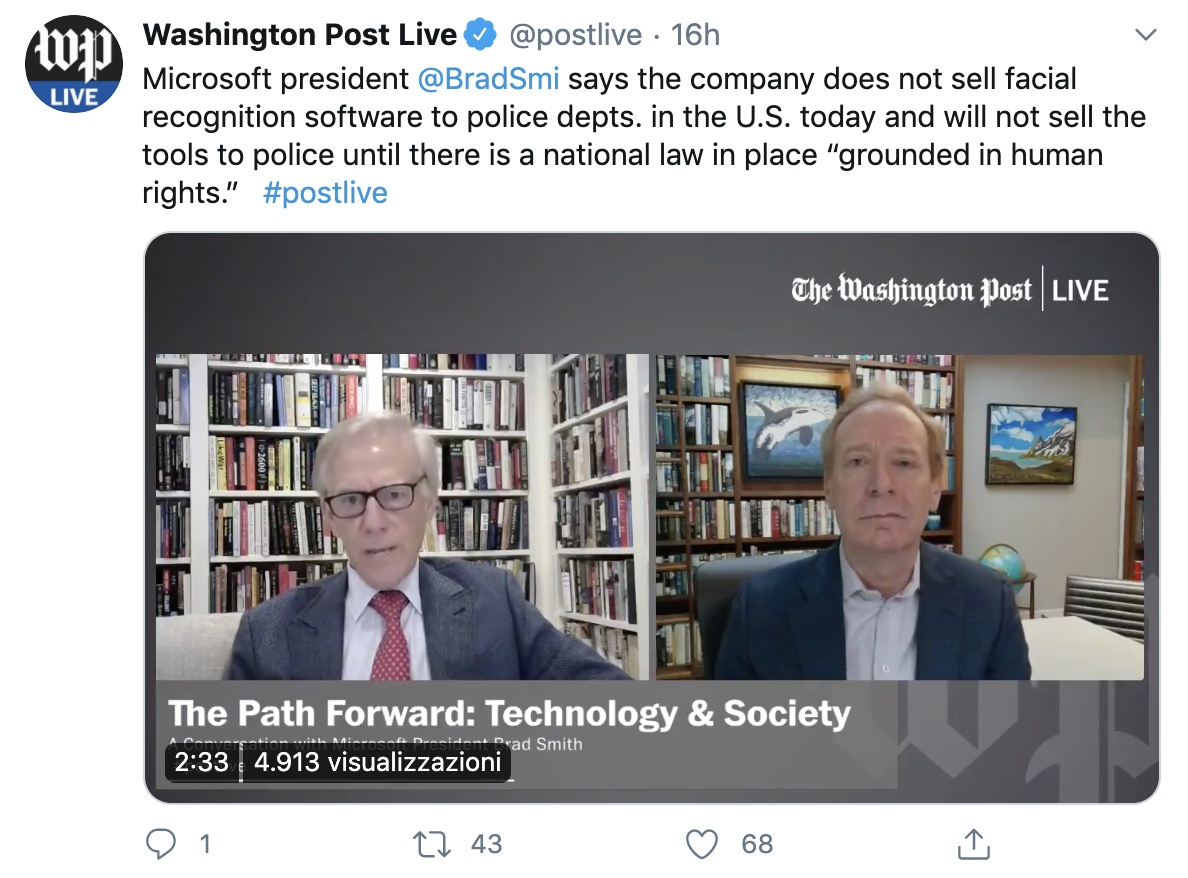

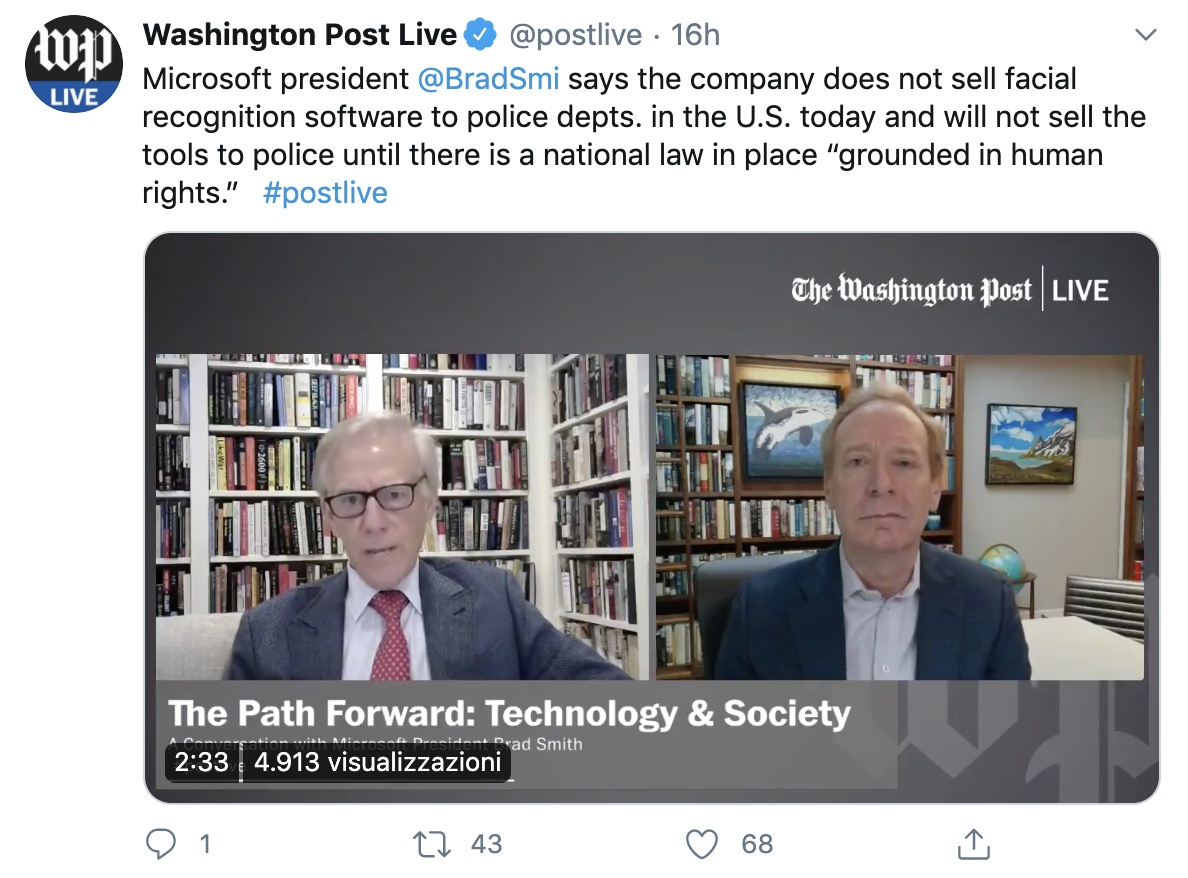

Anche Microsoft ha deciso di sospendere la vendita delle tecnologie per il riconoscimento facciale alle autorità di Polizia statunitensi. Lo ha dichiarato Brad Smith, il suo Presidente, al Washington Post. Il blocco delle vendite continuerà, secondo Smith, finché non sarà stata promulgata una legge che "governi questa tecnologia" e sia "basata sui diritti umani". Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Mag 12

SoftwareOne webinar - GitHub Copilot 2026: cosa è cambiato davvero?

Mag 12

Amazon Bedrock per il business: Accelerare l'innovazione con la GenAI

Mag 21

Cloud AI Live Milano

Mag 26

CrowdTour 2026 - Milano

Mag 28

AWS Summit 2026 - Milano

Giu 11

MSP DAY 2026

Giu 17

Nutanix .NEXT On Tour Roma

Ott 07

Fortinet Security Day - Roma

Ott 28

Fortinet Security Day - Milano

Ultime notizie Tutto

CallPhantom: 28 app false su Google Play, 7,3 milioni di download

08-05-2026

Dal cloud all’IA agentica: perché la sicurezza deve evolvere più rapidamente dell’innovazione

08-05-2026

HWG Sababa accreditata come Laboratorio Accreditato di Prova da ACN

08-05-2026

Phishing via Amazon SES: il vettore d’attacco sono chiavi IAM esposte

08-05-2026

f.p.

f.p.