Anthropic e Claude Mythos: tanto rumore per (quasi) nulla

La documentazione a supporto della carica rivoluzionaria di Claude Mythos non la avvalora granché, alla fine. E restare così nel vago genera diffidenza.

La notizia "bomba" di questi giorni in campo cybersecurity - il caso Anthropic Mythos - è stata vista in molti modi diversi. Colpa anche di Anthropic stessa, che ha affermato grandi cose senza dare loro granché sostanza, spostando quindi il discorso verso le posizioni estreme: chi l'ha visto come l'ennesimo eccesso dell'hype pro-AI, chi ha visto confermata la sua nuova fede nel verbo dell'AI "totale" per la cybersecurity. Per chi sta nel mezzo, gli spunti interessanti peraltro non mancano, e vanno anche oltre Mythos in sé.

Facciamo un passo indietro. Tutto nasce dal fatto che Anthropic - che in quanto a cybersecurity, insomma - ha annunciato una "preview" limitata del suo nuovo modello Claude Mythos. Il quale sarebbe tanto potente nell'individuare e sfruttare vulnerabilità software da non poterlo rendere pubblico: il rischio che lo usino i threat actor per scatenare il caos digitale è troppo grande. "Mythos Preview has already found thousands of high-severity vulnerabilities, including some in every major operating system and web browser", afferma testualmente Anthropic. Così è nato Project Glasswing, un gruppo di organizzazioni che useranno Mythos in maniera controllata nelle loro attività di cybersecurity. Il gruppo, oltre ovviamente ad Anthropic, comprende Apple, AWS, Broadcom, Cisco, Crowdstrike, Google, JPMorganChase, la Linux Foundation, Microsoft, Nvidia, Palo Alto Networks. Più una quarantina di partner tecnici meno noti.

Ma cosa fa Mythos di così travolgente da dover essere tenuto segreto? Cosa vuol dire che "ha già trovato migliaia di vulnerabilità ad alta severità, incluse alcune in ognuno dei principali sistemi operativi e web browser"? Dato che Mythos è proprietario, non si può usare e il suo codice non è disponibile, le fonti originali da considerare sono tre: la pagina web di lancio di Project Glasswing (fonte principale di quasi tutto quello che si è letto sui media), un lungo blog post tecnico di Anthropic, infine e soprattutto la System Card: Claude Mythos Preview, che dovrebbe essere il documento ufficiale di riferimento per Mythos.

La System Card è un documento lungo ben 244 pagine che racconta ragionevolmente tutto di Mythos, ed è il documento che in teoria fa da riferimento principale per qualsiasi analisi tecnica, di auditing e anche di compliance. In sostanza: nei comunicati stampa e nei blog post si può dire un po' di tutto, la System Card è invece un documento quasi ufficiale, anche se non è standardizzato e non è citato esplicitamente in alcuna normativa sull'AI. Quindi fa effetto che quella di Mythos dedichi alla cybersecurity solo le sette pagine del capitolo 3: per un modello che dovrebbe rivoluzionare la sicurezza cyber, è un po' poco.

La carta d'identità di Mythos

Nel suo blog post, Anthropic spiega che non può dare molti dettagli su cosa è capace di fare Mythos, perché il 99% delle vulnerabilità che ha trovato non sono state corrette e quindi sarebbe irresponsabile parlarne adesso. Anthropic può parlare solo dell'1% dei bug scoperti da Mythos, perché si tratta di bug noti e risolti. Già questi - è il messaggio - bastano però per descrivere "un salto sostanziale in quella che crediamo sia la nuova generazione delle capacità dei modelli in ambito cybersecurity".

Ma è davvero così? La System Card di Mythos Preview, innanzitutto, non cita da nessuna parte "migliaia" di bug trovati. Cita solo, quantitativamente, i risultati che il nuovo modello fa registrare rispetto a due banchmark noti - Cybench e CyberGym - e uno dei risultati a cui è stato dato più rilevo da Anthropic in tutta la sua documentazione più o meno ufficiale: lo sviluppo automatico di exploit efficaci per una vulnerabilità nota di Firefox versione 147 (risolta nella versione 148). Ma anche qui si resta inevitabilmente perplessi.

In Cybench e CyberGym, Claude Mythos Preview batte o eguaglia i modelli Anthropic precedenti, ma non in maniera eclatante. Fa pari con Claude Opus 4.6 (il migliore dei precedenti) in Cybench - che include 40 challenge Capture-the-Flag - e lo batte (0,83 contro 0,67) in CyberGym, un test di "targeted vulnerability reproduction" in cui l'agente di AI testato deve trovare vulnerabilità già note a partire da una loro descrizione di alto livello. Mythos fa meglio, insomma, ma niente di rivoluzionario.

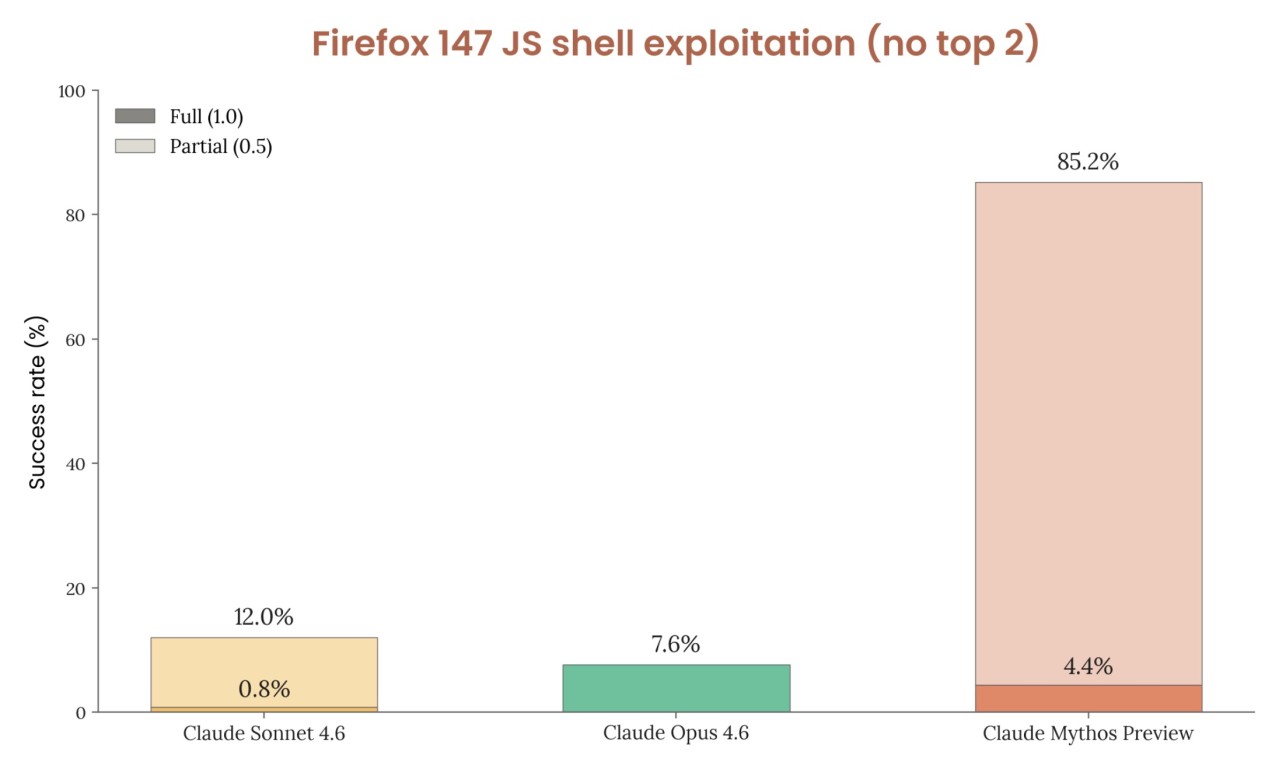

Il caso-Firefox è... curioso. Mythos non scopre di suo le vulnerabilità che possono portare a una esecuzione di codice da remoto (RCE), perché queste - 50 di numero - sono state scoperte da Claude Opus 4.6 e poi passate a Mythos. Sono quindi vulnerabilità note, per il nuovo modello. Per ciascuna di esse vengono effettuate 5 prove di generazione di exploit, per un totale di 250 prove. Attenzione, però: l'attacco non viene effettivamente portato contro il browser Firefox in versione 147, ma contro solo il suo motore JavaScript - SpiderMonkey - impacchettato in un container che imita Firefox, ma senza la sua sandbox e senza altre forme di difesa e mitigazione. Insomma, un non-Firefox azzoppato in partenza.

Comunque, in questi test Mythos produce effettivamente 181 exploit che portano a una RCE totale e altri 26 che portano a un crash del motore JavaScript. Una cifra che fa efetto: 181 exploit contro un (pezzo di) software importante. Solo che non è effettivamente così. Anthropic onestamente spiega che quasi tutti questi exploit sfruttano le medesime due vulnerabilità: non importa da quale "crash category" Mythos inizi la sua analisi, alla fine produce quasi sempre un exploit che punta su uno di due bug noti. Se si tolgono questi macro-bug dall'analisi, la capacità di Mythos di generare exploit efficaci con una FCE completa crolla al 4,4%. Meno di Claude Sonnet 4.6, che arrivava al 7,6%.

Dai numeri alle sensazioni

Questi sono i test con delle cifre a supporto. Poi la System Card di Mythos Preview prosegue in maniera del tutto qualitativa, indicando che il nuovo cyber-modello è stato passato a partner terzi per test esterni. I risultati di questi test indicano che Mythos è il primo modello in grado di effettuare attacchi completi in ambienti "del mondo reale", che per Anthropic significa ambienti che comprendono "software obsoleto, errori di configurazione, credenziali riutilizzate". Mythos ha anche completato un attacco di rete che "si stima avrebbe richiesto dieci ore ad un esperto" (stima su che basi, e che avrebbe fatto l'esperto in tutte queste ore?).

Tutto questo per Anthropic indica che Mythos può condurre in autonomia attacchi completi "contro almeno reti enterprise di piccola scala con una postura di sicurezza debole (senza difese attive, con un minimo monitoraggio di sicurezza e capacità di risposta lente)". Comunque, Mythos "è stato incapace di risolvere simulazioni cyber in un ambiente OT", e "non è riuscito a trovare alcun nuovo exploit per una sandbox configurata in modo appropriato e con patch moderne". Non è che si voglia fare gli scettici a tutti i costi, ma queste frasi messe insieme assomigliano a "Mythos non è riuscito a fare granché contro chi si difende in maniera almeno decente".

La System Card finisce sostanzialmente qui, per la parte sicurezza. Diversi spunti in più si trovano nel citato blog post tecnico di Anthropic, che riporta anche altri casi di vulnerabilità zero-day che Mythos Preview ha identificato "senza alcun intervento umano dopo un prompt iniziale che chiedeva di trovare una vulnerabilità". Si tratta di due bug a cascata in OpenBSD, una vulnerabilità nel codec H.264 di FFmpeg, un bug per corruzione della memoria in un Virtual Machine Monitor in produzione e presunto memory-safe. E poi ci sono "alcune migliaia" di bug in più che sono in fase di valutazione.

Cosa più importante, Anthropic spiega che Mythos, una volta scoperte le vunlerabilità, è stato spesso in grado di generare exploit che potessero sfruttarle. È in effetti qui che si trova il bello della questione-Mythos: il modello non sembra poi così tanto più bravo di altri a trovare bug, ma dovrebbe esserlo (il condizionale è d'obbligo) nell'indicare come sfruttarle.

Da questo punto di vista però va colta anche l'analisi che ha fatto Aisle - una software house che applica l'AI alla cybersecurity - su quanto sia davvero necessario puntare su modelli LLM chiusi rispetto alle potenzialità degli LLM open source. Secondo i test di Aisle - in estrema sintesi e semplificando - nella ricerca delle vulnerabilità descritte da Anthropic diversi modelli "aperti" - come DeepSeek, Gemma o Qwen - danno risultati analoghi a Mythos Preview, con un costo per token di ordini di grandezza inferiore, e questi risultati non aumentano proporzionalmente al numero di parametri del modello. Nella fase di generazione di exploit i modelli open non sembrano dare risultati a livello del nuovo LLM di Anthropic, ma se adeguatamente "guidati" non ci arrivano tanto lontano, per chi sa comprenderli e sfruttarli.

Un errore di marketing

Cerchiamo di tirare qualche somma. Di certo Anthropic si è fatta prendere la mano dal marketing e questo ha portato a una situazione imbarazzante in cui affermazioni roboanti e categoriche sul futuro della cybersecurity non si sono trovate supportate da fatti e numeri concreti. Se Mythos è davvero rivoluzionario, per il momento Anthropic non l'ha dimostrato. Di certo però Mythos conferma le potenzialità nell'uso degli LLM per la ricerca di vulnerabilità e parzialmente per le scrittura di exploit. Mythos sembra uno strumento che nelle mani dei threat actor potrebbe fare molti danni contro bersagli difesi male, resta da capire se sarebbero davvero tanti più rispetto ad altri modelli già accessibili.

Anthropic ha comunque anche il merito - questo sicuramente involontario - di aver riportato in auge una vecchia questione: quando il gioco si fa duro lato cyber, è meglio la sicurezza "by obscurity" del codice - in questo caso un LLM - proprietario che si tiene chiuso da qualche parte, con accesso limitato? O la strada migliore è ancora quella dell'apertura, come è stato per l'open source e potrebbe essere ora per gli LLM (più) aperti? Questo sarà un dibattito lungo.

Per ora il caso Mythos non ci ha portato più in là di dove eravamo prima, alla fine: tanto marketing per quasi nulla. A meno che Anthropic non ci stupisca davvero con il contenuto di un promesso report sulle "migliaia" di vulnerabilità che sarebbero adesso sotto esame. Report che dovrebbe arrivare entro 90 giorni e che dovrebbe anche dare più senso a Project Glasswing. Perché sulla base del materiale che Anthropic ha reso pubblico sinora, non si capisce il senso di una alleanza di così grandi nomi. Se non quello di un generico interesse per la cybersecurity AI-powered.

In questo articolo abbiamo parlato di: Artificial Intelligence, Cybersecurity, Exploit Development, Large Language Models, Security Auditing, Software Security, Threat Actors,

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

Anthropic e Claude Mythos: tanto rumore per (quasi) nulla

27-04-2026

Vulnerabilità senza patch in alcuni chip Qualcomm

27-04-2026

Agenti AI fuori controllo: la sicurezza non tiene il passo

27-04-2026

Quando l’IT è governata dall’AI agentica: come rendere sicura l’autonomia

27-04-2026

f.p.

f.p.