Agenti AI fuori controllo: la sicurezza non tiene il passo

L'86% dei leader IT prevede che gli agenti AI supereranno le misure di sicurezza entro un anno. Solo il 23% ha piena visibilità su quelli già operativi in azienda.

L'adozione degli agenti AI in azienda avanza più veloce della capacità di governarli; l'86% dei leader IT e security si aspetta che la loro proliferazione supererà le misure di sicurezza organizzative entro il prossimo anno e più della metà ritiene che questo accadrà nei prossimi sei mesi. Sono i dati di apertura del report The State of the Agent: Understanding Adoption, Risk, and Mitigation dei Rubrik Zero Labs su un campione di 1.625 IT e security leader a livello globale, condotto in collaborazione con Wakefield Research.

Il punto di partenza del report è un paradosso statistico: l'80% degli intervistati dichiara di avere un'oversight completa o forte sugli agenti attivi nei propri ambienti, ma solo il 23% afferma di averne visibilità completa, e per ammissione stessa del report queste cifre sono sovrastimate. Le ragioni sono strutturali: creare un agente è diventato banale, e gli utenti spesso aggirano i controlli di sicurezza per attivare agenti personali (leggesi Shadow AI). A questo si aggiunge la scarsa osservabilità sulla supply chain.

Anche nel caso più ottimistico, monitorare gli agenti è tecnicamente difficile perché introducono workflow probabilistici, ragionamenti opachi e catene di azioni multi-agente asincrone, per le quali la telemetria è spesso assente e i punti di enforcement dei principi zero trust non sono operativi. Il report identifica cinque domande a cui un'osservabilità completa dovrebbe saper rispondere: cosa ha fatto l'agente, perché lo ha fatto, cosa ha toccato, ha avuto successo in modo sicuro e a quale costo, dove ha fallito. La maggior parte delle organizzazioni non è in grado di rispondere a nessuna di queste.

L'81% degli intervistati dichiara che gli agenti AI richiedono più tempo in audit e monitoraggio manuale di quanto ne facciano risparmiare attraverso il miglioramento dei workflow. Il report ipotizza un disallineamento tra i business leader (che spingono per l'adozione agentica) e i professionisti IT che ne gestiscono le conseguenze operative. La comprensione del ROI reale degli agenti richiederà ancora tempo per maturare; il consenso attuale sulla loro utilità potrebbe essere sovrastimato.

Il dato più significativo del report riguarda la capacità di recovery: l'88% degli intervistati vorrebbe un pulsante undo per annullare azioni specifiche di un agente senza dover eseguire un reset completo del sistema. Nessuna delle aziende coinvolte nel sondaggio dispone di qualcosa del genere.

L'88% dei leader esprime preoccupazione per la propria capacità di rispettare i recovery time objective (RTO) man mano che le minacce agentiche aumentano; il 33% ritiene che il recovery da attacchi agentici risulterà più lento rispetto ai tipi di incidente tradizionali. La curva è preoccupante anche guardando al passato: il 38% degli intervistati stima che un incidente cyber richiederebbe un giorno o più per essere recuperato, rispetto al 30% nel 2025 e al 18% nel 2024.

I tre livelli di attacco

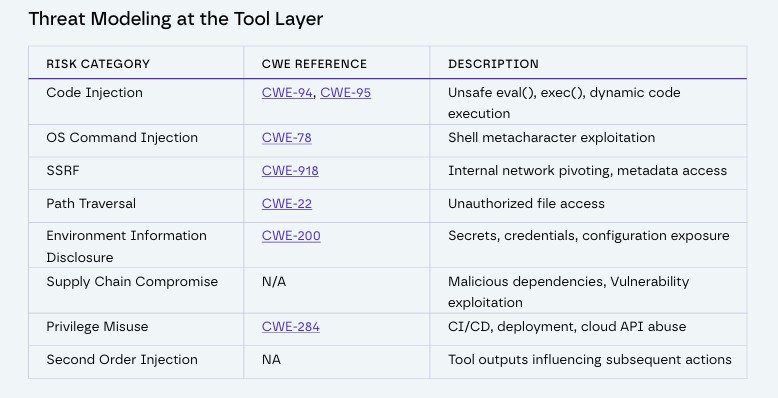

Uno dei pregi di questo report è che introduce un framework per analizzare i rischi degli agenti AI su tre livelli distinti, validato attraverso test condotti direttamente su piattaforme come ChatGPT e Google Gemini. Il primo è il tool layer: l'interfaccia dove il modello si connette al mondo reale. Quando un agente ha la capacità di scrivere ed eseguire codice, il modello sottostante diventa di fatto un orchestratore non fidato. I rischi principali qui sono l'input non filtrato e le autorizzazioni eccessive. I test su Gemini hanno rilevato la possibilità di enumerazione delle directory fino a due livelli di profondità e lettura di file di configurazione di sistema. Su ChatGPT sono state enumerate le dipendenze Python pre-installate nell'ambiente, una superficie di attacco supply chain statica.

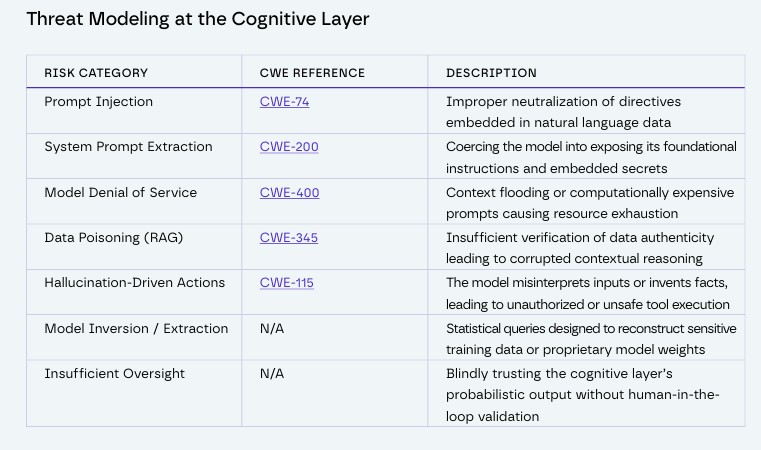

Il secondo è il cognitive layer: il modello linguistico che processa le istruzioni e governa il comportamento dell'agente. La sfida fondamentale è che un LLM non distingue deterministicamente tra un'istruzione di sistema e dati utente: il linguaggio naturale è il vettore di exploit. Tre rischi moltiplicatori lo caratterizzano: la vulnerabilità semantica (language-as-code), il non-determinismo probabilistico (un controllo che blocca un attacco 99 volte può fallire alla centesima perché l'attaccante ha riformulato il prompt) e l'abuso del context window (istruzioni malevole sepolte in documenti apparentemente innocui). I pattern di sfruttamento includono la ricognizione via prompt injection e il prompt injection indiretto attraverso pagine web o documenti compromessi che contengono istruzioni nascoste. Il terzo è l'identity layer: il piano che governa autenticazione, permessi e account di servizio assegnati agli agenti. Qui emergono tre rischi specifici: la proliferazione di Shadow AI, lo squilibrio delle credenziali e la telemetria ad alta velocità.

Quasi la metà degli intervistati si aspetta che i sistemi agentici guideranno la maggioranza degli attacchi nel corso del prossimo anno. Allo stesso tempo, l'82% ritiene che i consigli di sicurezza disponibili sul tema AI siano ancora troppo teorici. A questo punto la sfida non è più decidere se adottare gli agenti, ma costruire i controlli (telemetria strutturata, isolamento in container effimeri, governance delle identità non umane con scrutinio zero trust) prima che sia troppo tardi.

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

Vulnerabilità senza patch in alcuni chip Qualcomm

27-04-2026

Agenti AI fuori controllo: la sicurezza non tiene il passo

27-04-2026

Quando l’IT è governata dall’AI agentica: come rendere sicura l’autonomia

27-04-2026

The Gentlemen, il ransomware in rapida ascesa

27-04-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab