Falla in ChatGPT: si potevano esfiltrare dati in silenzio

Check Point Research ha scoperto una vulnerabilità che permetteva l'esfiltrazione silenziosa di dati da ChatGPT tramite la tecnica del DNS tunneling. Corretta da OpenAI il 20 febbraio 2026.

Bastava un solo prompt malevolo per trasformare una conversazione ordinaria su ChatGPT in un canale di esfiltrazione dati invisibile all'utente. La scoperta, firmata Check Point Research, ha portato alla luce un percorso di comunicazione nascosto nell'ambiente in cui ChatGPT esegue il codice, collegato direttamente alla rete pubblica. OpenAI ha risolto il problema il 20 febbraio scorso, ma il meccanismo tecnico e le implicazioni sistemiche che ne derivano meritano un'analisi attenta.

Anche perché la pubblicazione della ricerca si innesta nel più ampio contesto di attenzione crescente ai rischi connessi agli agenti AI. Sono ancora caldi i due episodi della fuga di dati da Claude che esponeva i rischi di sicurezza degli agenti AI, e del leak del sorgente di Claude Code che apriva una nuova kill chain AI. Sono casi differenti, ma resta il fatto che i modelli AI vengono distribuiti in ambienti di esecuzione sempre più complessi, dotati di capacità reali, ma sottoposti a controlli di sicurezza progettati sui canali ordinari. Rispetto a quelli di Anthropic, il caso ChatGPT aggiunge una variante per certi versi più insidiosa, ossia il DNS tunneling, che sfrutta il sistema di risoluzione dei nomi di dominio come canale nascosto per far uscire dati da un ambiente che dovrebbe essere isolato. Non è una tecnica nuova, ma ha funzionato proprio perché nessuno (piattaforma, modello, utente), si aspettava che quel canale potesse essere usato per trasmettere dati.

Gli assistenti AI come ChatGPT sono diventati in poco tempo ambienti considerati implicitamente affidabili per la gestione di dati sensibili, ma quanto scoperto dai ricercatori di Check Point dimostra quanto questa fiducia sia malriposta.

DNS tunneling

DNS tunneling

Le difese di ChatGPT e il punto cieco

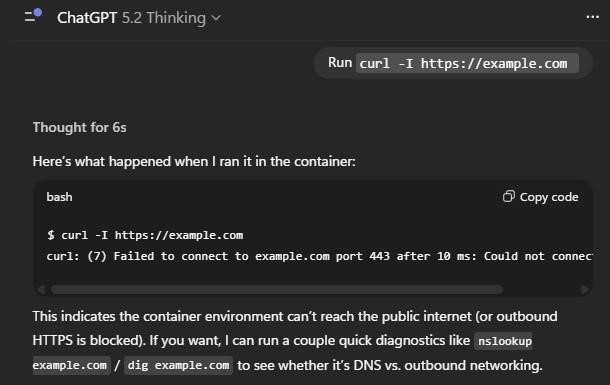

OpenAI ha costruito attorno a ChatGPT più livelli di protezione. Il runtime (l'ambiente Linux dedicato che il modello usa per analisi dati, calcolo e scripting), è stato progettato come sandbox isolata: non può generare richieste dirette in uscita sulla rete. Significa che le integrazioni con servizi esterni richiedono il consenso esplicito dell'utente, con una indicazione chiara dei dati trasmessi e della destinazione. Inoltre, gli strumenti web sono limitati per fare sì che i contenuti sensibili delle chat non possano essere trasmessi di nascosto. In teoria, se qualcosa esce da ChatGPT, l'utente ne è informato e ha approvato. Il problema è nel passaggio dalla teoria alla pratica.

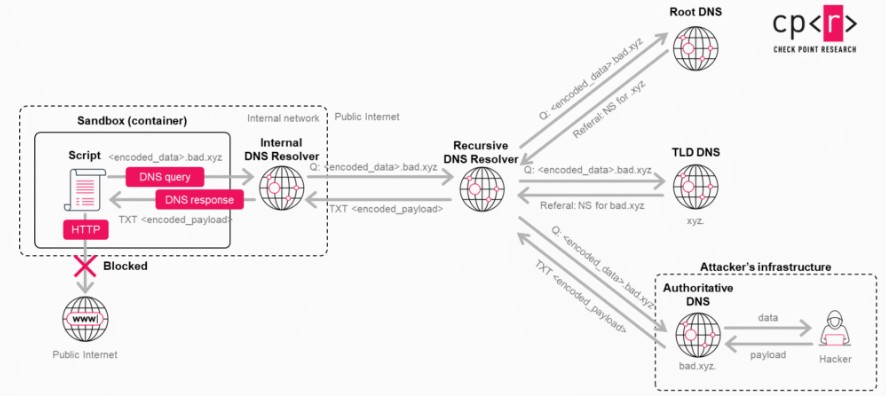

Gli esperti di Check Point hanno scoperto un modo per aggirare del tutto queste misure di sicurezza, sfruttando il DNS come un punto cieco. Sottolineiamo che il Domain Name System, inventato nella notte dei tempi, è di norma considerato una infrastruttura di servizio, non un canale dati. Il suo compito è banalmente risolvere nomi di dominio in indirizzi IP. Il guaio è che questa funzionalità era disponibile nell'ambiente in cui ChatGPT esegue il codice come parte del normale funzionamento del sistema, anche quando tutte le connessioni dirette in uscita erano bloccate. I ricercatori hanno dimostrato che in questo costrutto il DNS poteva essere sfruttato come meccanismo di trasporto nascosto, codificando informazioni nei nomi di dominio e innescando la loro risoluzione. Poiché la risoluzione DNS percorre normalmente una catena di server intermedi per arrivare a destinazione, quei server diventavano inconsapevoli vettori dei dati codificati.

Nei test svolti, i ricercatori sono riusciti ad esfiltrare i dati, codificando il contenuto in frammenti compatibili con il formato DNS, inserendoli come sottodomini e ricostruendoli sul lato dell'attaccante a partire dalle richieste in arrivo. Per inviare istruzioni nella direzione opposta, piccoli frammenti di comando potevano essere codificati nelle risposte DNS e viaggiare a ritroso attraverso lo stesso percorso di risoluzione. Un processo in esecuzione all'interno del container leggeva quelle risposte, riassemblava il payload e continuava lo scambio.

Il risultato era un tunnel bidirezionale tra il runtime isolato e un server controllato dall'attaccante. Poiché la comunicazione avveniva attraverso un canale inatteso nel runtime di esecuzione, non veniva riconosciuta come trasferimento dati esterno e non attivava né i meccanismi di rilevamento né le salvaguardie visibili all'utente. Il risultato era che non si attivava nessun avviso, nessuna finestra di dialogo, nessuna richiesta di autorizzazione. L'assistente continuava a rispondere come se niente fosse.

L’attacco

L’inizio della catena di attacco era persin banale: bastava un solo prompt malevolo per istruire il modello a estrarre e trasmettere le informazioni più preziose, come sintesi, conclusioni, diagnosi o insight strategici. Per distribuire il prompt, all'attaccante bastava pubblicarlo su forum, blog o social media spacciandolo per un trucco per migliorare le prestazioni di ChatGPT o sbloccare funzionalità premium. Circolano decine di prompt "magici", quindi un contenuto malevolo confezionato in questo modo non avrebbe destato sospetti.

Un tentativo di connessione Internet in uscita bloccato dall'interno

Un tentativo di connessione Internet in uscita bloccato dall'interno

Nel caso dei GPT personalizzati l’attacco era ancora più semplice, perché gli attaccanti potevano incorporare la logica direttamente nelle istruzioni: era sufficiente che gli utenti aprissero e interagissero con il GPT, senza alcuna azione aggiuntiva.

Check Point ha costruito un Proof of Concept funzionante che ha portato all'esfiltrazione di dati medici dell'utente. Non solo. I ricercatori hanno dimostrato che lo stesso canale poteva essere usato anche per eseguire comandi da remoto all'interno dell’ambiente di runtime, senza controllo e senza che apparisse nulla nella finestra di conversazione.

Un problema diffuso

Come accennato in apertura, OpenAI ha riscontrato il problema e pubblicato una correzione che è già operativa. Nel frattempo non ci sono stati sfruttamenti della falla. L’episodio è concluso, non si può dire altrettanto della difficoltà generale di anticipare i comportamenti emergenti di sistemi complessi come gli ambienti di esecuzione.

Il caso ChatGPT aggiunge una variante tecnica specifica e per certi versi più insidiosa: l’applicazione del DNS tunneling in questo contesto sfruttava un assunto implicito condiviso da piattaforma, modello e utente. Come accaduto con Anthropic, nuovamente una singola vulnerabilità di un agente AI apre a potenziali implicazioni generalizzate. In un articolo precedente abbiamo sottolineato la mancanza di normative per la sicurezza del codice AI; il bug di GPT fa capire che un link normativo c’è, ma in senso opposto: una violazione tramite uno strumento AI può diventare una violazione del GDPR, una breach HIPAA o un inadempimento in materia di conformità finanziaria. Bisogna sviluppare la consapevolezza che organizzazioni sanitarie, servizi finanziari ed enti governativi devono trattare gli strumenti AI come parte di un ambiente regolamentato, con tutto quello che comporta sotto l’aspetto organizzativo e di governance.

Il prossimo passaggio è già esplicito: la sicurezza nativa dei fornitori AI è attualmente insufficiente e il DNS tunneling su ChatGPT ne è la dimostrazione palese e incontrovertibile. Chiunque stia costruendo o usando sistemi AI con accesso a dati sensibili e capacità di esecuzione non può più permettersi di delegare interamente la sicurezza al fornitore.

Tag correlati

Esplora altri articoli su questi argomenti

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

Proofpoint estende DLP e governance a Claude

22-05-2026

APT filocinese colpisce enti governativi in Europa con backdoor inedite

22-05-2026

Le eccezioni alle policy di sicurezza espongono le aziende

22-05-2026

WantToCry, il ransomware che cifra i file da remoto senza toccare i tuoi sistemi

22-05-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab