AI e collaboration security: il ritardo dei controlli presenta il conto

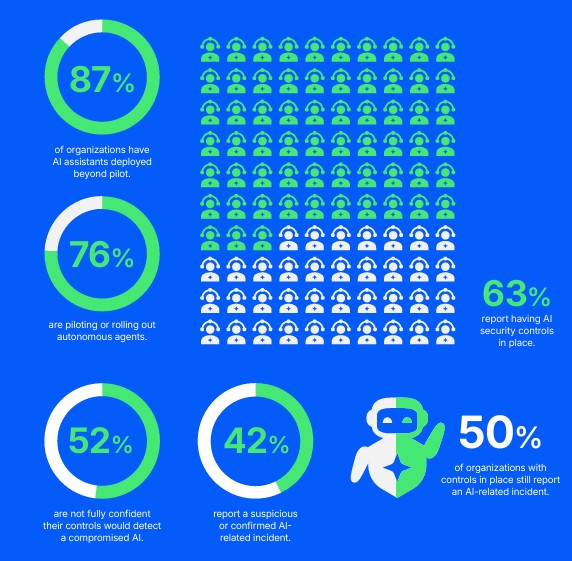

L'87% delle organizzazioni ha superato la fase pilota nell'adozione degli assistenti AI, ma il 52% non è sicuro che i propri controlli di sicurezza rileverebbero un'AI compromessa.

Il 63% delle aziende dichiara di avere controlli di sicurezza sull'AI in uso; il 52% non è pienamente convinto che siano in grado di rilevare compromissioni. Ancora peggio: il 50% di chi ha controlli attivi sull’AI ha già registrato un incidente correlato all’AI. Sono i dati significativi che aprono il 2026 AI and Human Risk Landscape Report di Proofpoint e che, messi in fila, sottolineano come disporre di controlli non equivale ad avere controllo. La ricerca è basata su un sondaggio condotto 1.453 professionisti della sicurezza in 20 settori e 12 mercati, Italia inclusa. Il campione comprende CISO, CTO, direttori e manager della sicurezza IT; quasi otto intervistati su dieci lavorano in organizzazioni con almeno 500 dipendenti.

Il punto di partenza è la velocità con cui l'AI è diventata infrastruttura operativa. L'87% delle aziende ha già superato la fase pilota con gli assistenti AI; il 76% sta avviando o ampliando il deployment di agenti autonomi. Il salto è significativo perché un assistente supervisionato crea un profilo di rischio, un agente autonomo ne crea uno radicalmente diverso perché agisce su informazioni affidabili alla velocità della macchina, su più sistemi, senza attendere validazione. Il 69% delle imprese usa l’AI per supporto clienti o tecnico; il 67% per la sintesi delle conversazioni su Slack o Teams; il 63% per la redazione e il riassunto delle email; il 56% per la collaborazione con fornitori e partner terzi. Quelli appena elencati sono i canali dove transitano dati sensibili ogni giorno e dove si manifestano le minacce.

Peccato che alla velocità di adozione corrisponda un ritardo della governance: solo il 48% degli intervistati dichiara che la sicurezza è stata integrata fin dall'inizio nella strategia AI; il 52% la descrive come reattiva, inconsistente o in fase di recupero. Non è un problema di budget perché oltre il 90% delle organizzazioni dispone già di copertura finanziaria, dedicata o riallocata, per la sicurezza AI. Il problema è che molti strumenti di sicurezza sono stati costruiti per un modello di minaccia pre-AI.

Eppure i controlli esistono, il problema è che non reggono per mancanza di formazione, per scarsa visibilità sulle azioni di AI o agenti, per disallineamento di governance tra IT, security e business, per monitoraggio insufficiente o assenza di un modello capace di rilevare le AI compromesse. Inoltre, i controlli non sono stati progettati per proteggere una superficie di collaboration in cui l'AI opera su tutti i canali contemporaneamente. Per capire: le aziende che hanno già subìto un incidente correlato all’AI hanno rilevato un pattern di distribuzione che coinvolgeva email, SaaS e cloud app al 57%, assistenti o agenti AI, strumenti di collaboration, piattaforme social e file sharing, e SMS. In sostanza, le minacce si muovono attraverso tutta la superficie sfruttando la fiducia che gli ambienti integrati costruiscono tra utenti, sistemi e AI.

Proofpoint ha tracciato la crescita delle applicazioni con funzionalità AI autorizzate dagli utenti tramite consenso OAuth e ha rilevato un aumento di 22 volte in meno di un anno. La normalizzazione di questa abitudine di consenso è quello su cui fanno leva le campagne di consent phishing, che sfruttano le schermate di autorizzazione legittime per ottenere accesso a posta, file e conversazioni. Man mano che concedere permessi ampi agli strumenti AI diventa routine, gli utenti tendono a prestare meno attenzione a ciò che stanno effettivamente autorizzando.

Investigare sugli incidenti

Il quarto capitolo del report affronta il tema della ricostruzione della catena di attacco. Solo il 32,6% delle organizzazioni si dichiara pienamente preparato a investigare un incidente AI o agent-correlato; il 68% non lo è. Il 41% non riesce a correlare minacce e incidenti su canali multipli. Il 95% considera moderatamente difficile (nel migliore dei casi) la gestione di più strumenti di sicurezza; il 53% la definisce molto o estremamente difficile.

Le conseguenze di questa situazione sono costi elevati, problemi di integrazione e workflow, difficoltà di correlazione tra canali, gap di visibilità, ridondanza degli strumenti, alert fatigue. Quando un incidente attraversa più canali in pochi secondi, gli strumenti frammentati non riescono a ricostruire la sequenza di attacco. Il 61% delle organizzazioni prevede di espandere le protezioni AI; il 56% di estendere la copertura della collaboration security; il 53% di passare a una piattaforma unificata. Una traiettoria coerente con la direzione che Proofpoint ha imboccato con l'acquisizione di Acuvity e con il lancio di Proofpoint AI Security, pensata per portare rilevamento intent-based sulle azioni degli agenti autonomi su endpoint, browser e connessioni MCP.

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

AI e collaboration security: il ritardo dei controlli presenta il conto

29-04-2026

Dispositivi edge sempre più interessanti per gli attaccanti

29-04-2026

Quando una chiavetta USB è il rischio più grande

29-04-2026

Il 2025 è stato solo il banco di prova: la speranza non è una strategia di cybersecurity

29-04-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab