Quando l'AI diventa vettore di supply chain attack, l’analisi dell’esperto

Marco Rottigni di SentinelOne analizza i rischi degli agenti AI con permessi illimitati: una superficie di attacco nuova, sfruttata con strategie vecchie come la compromissione della supply chain.

Gli episodi relativi ai modelli AI a cui abbiamo assistito nelle ultime settimane impongono una riflessione sui rischi reali delle tecnologie a cui stiamo delegando parte del lavoro quotidiano in azienda. Il punto non è il singolo incidente, ma lo schema che li accomuna: come ci ha spiegato Marco Rottigni, Global Solutions Architect di SentinelOne, siamo di nuovo davanti a una sottovalutazione del rischio legato alle supply chain, con l’AI generativa che rappresenta l’ennesimo anello debole della supply chain digitale, capace di trasformarsi in vettore di attacchi anche quando fa esattamente quello per cui è stata progettata. È in questo contesto che Rottigni avverte: “stiamo dando agli agenti AI un livello di fiducia e di poteri che spesso non concederemmo nemmeno a un consulente umano, e questo è il rischio più grande che possiamo prenderci”.

Nel caso di Claude Code, un agente AI pensato per aiutare gli sviluppatori è diventato il veicolo inconsapevole per distribuire una versione trojanizzata di LiteLLM, nell’ambito di un’operazione di compromissione della supply chain che SentinelOne ha intercettato e bloccato grazie a un agent basato sull’analisi comportamentale. La stessa logica di fondo si ritrova nella vulnerabilità zero‑click di Claude Desktop e nella falla in ChatGPT che permetteva l’esfiltrazione silenziosa di dati via DNS tunneling: un modello o un agente che gode di fiducia elevata e di privilegi estesi diventa, con un singolo prompt o con un bug non banale, un canale nascosto per aggirare controlli e barriere.

Il fil rouge che accomuna questi episodi è una superficie di attacco nuova, sfruttata con la strategia antica della compromissione della catena di fornitura. “Dal punto di vista strategico non c’è nulla di nuovo: l’idea è sempre quella di colpire l’anello debole”, osserva Rottigni. “Un tempo era il consulente con il laptop poco aggiornato, in possesso del badge per entrare in azienda, oggi è l’agente AI a cui abbiamo dato la possibilità di eseguire azioni per conto nostro, spesso senza limiti chiari e delimitati”.

Il parallelo con SolarWinds viene quasi spontaneo: un software usato da un numero enorme di aziende che, una volta armato, diventa il cavallo di Troia per una propagazione capillare. Con LiteLLM e con i plugin di Claude Code descritti anche nell’analisi di Prompt Security, lo schema si ripete: componenti condivisi, fiducia generalizzata, un singolo punto di compromissione che amplifica all’istante la superficie di attacco. Il leak del sorgente di Claude Code aggiunge un ulteriore livello di rischio: il codice dell’agent, scritto in parte dal modello stesso, presenta pattern ripetitivi e strutture prevedibili che facilitano l’analisi differenziale e la costruzione di exploit mirati.

Marco Rottigni, Global Solutions Architect di SentinelOne

Marco Rottigni, Global Solutions Architect di SentinelOne

Il salto qualitativo non sta tanto nella strategia, quanto nel ruolo dell’AI come soggetto operativo. Nel caso dell’attacco intercettato da SentinelOne, Claude Code era in esecuzione con l’opzione dangerously-skip-permissions, che di fatto cancellava qualsiasi principio di privilegio minimo. L’agente AI ha aggiornato in autonomia la dipendenza LiteLLM alla versione malevola e ha iniziato a eseguire una catena di azioni che, dal suo punto di vista, erano solo un’evoluzione coerente del compito assegnato. “Non c’è stata la classica mail con l’allegato sospetto, non c’è stato il doppio clic imprudente dell’utente”, sottolinea Rottigni, “c’è stato un sistema a cui avevamo dato fiducia illimitata, che ha fatto esattamente quello che gli avevamo permesso di fare. Questo è il punto”.

Lo stesso schema, osservato da un’altra angolazione, emerge nella vulnerabilità di Claude Desktop: una falla zero‑clic che permetteva a un file malevolo di attivare il client e di accedere ai contenuti dell’utente senza nessun gesto esplicito, sfruttando il fatto che il software, per design, può godere di accesso privilegiato al contesto locale. E lo ritroviamo nella vulnerabilità di ChatGPT analizzata da Check Point Research, dove un singolo prompt malevolo bastava a trasformare una conversazione ordinaria in un canale di esfiltrazione dati tramite DNS tunneling, invisibile all’utente e ai controlli applicativi che si aspettavano un runtime isolato dalla rete. In tutti questi casi, il modello non è impazzito, ha semplicemente sfruttato canali e poteri che gli sono stati concessi, spesso senza che nessuno abbia fatto un threat modeling completo delle implicazioni.

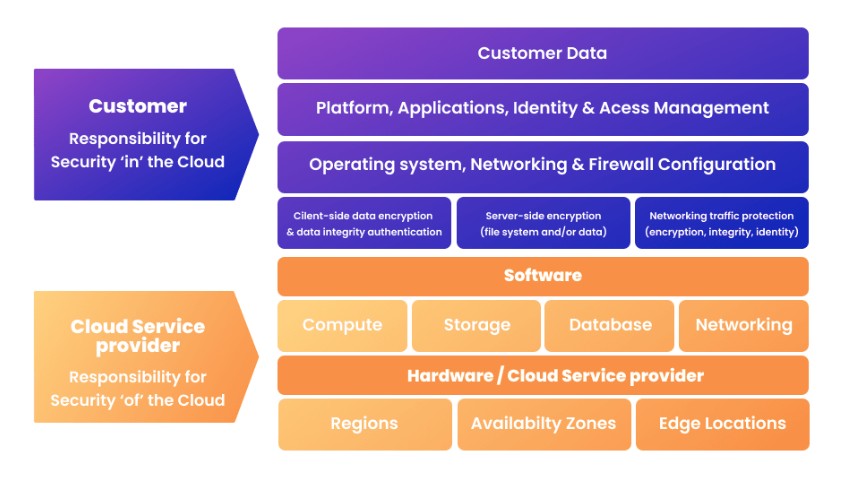

È per questo motivo che la riflessione sulla fiducia è inevitabile. Di conseguenza viene spontaneo il parallelo con il modello di responsabilità condivisa del cloud: “nel cloud, per quanto all’inizio ci siano stati fraintendimenti, la situazione è oggi relativamente chiara: da una parte c’è l’azienda, dall’altra l’hyperscaler, due soggetti giuridicamente responsabili, e tra loro si definiscono per contratto i confini della responsabilità”, ricorda Rottigni. Con gli LLM, lo scenario si capovolge: “qui non ci sono due entità giuridicamente senzienti. C’è un software e c’è l’utente”, sottolinea Rottigni, “noi prendiamo un sistema che non è senziente, gli diciamo che può fare della nostra infrastruttura quello che vuole perché è ‘intelligente’, perché è autonomo, perché è veloce, e gli concediamo privilegi che non diamo neppure all’hyperscaler. In tutto questo il responsabile rimane l’utente, non il software”.

Il modello di reszpnsabilità condivisa per il cloud

Il modello di reszpnsabilità condivisa per il cloud

Il problema non è aggirabile con soluzioni facili come applicare il modello Zero Trust alle identità macchina, perché come ricorda Rottigni, gli agenti AI vengono spesso configurati fin da subito come super utenti, in locale e nel cloud, a fronte del fatto che la promessa di automazione totale è troppo seducente rispetto al costo (percepito come ostacolo) di imporre limiti e controlli. La vicenda di Claude Code ne è un esempio pratico: l’esecuzione con permessi illimitati, combinata con l’aggiornamento automatico di una dipendenza compromessa e la sequenza di azioni che nessuno ha pensato di presidiare.

Claude Desktop fa un passo ulteriore e mostra un altro lato della stessa medaglia: un’app nativa che integra il modello nel desktop e che, proprio per essere “vicina” all’utente, eredita accessi e privilegi che la rendono un target particolarmente appetibile. ChatGPT, con il suo runtime Linux che doveva essere isolato ma che in realtà poteva instaurare un tunnel DNS nascosto verso un server esterno, dimostra come anche le architetture pensate con più livelli di difesa possano contenere punti ciechi quando si tratta di agenti che eseguono codice o interagiscono con l’infrastruttura circostante.

Da dove ha origine il problema? Secondo Rottigni siamo di fronte a una circostanza di immaturità sistemica: “non credo che stiamo violando dei modelli teorici, credo che siamo ancora in una fase in cui stiamo imparando come calarli nella pratica con quella che io chiamo la ‘seconda specie’, la specie tecnologica”, spiega. L’esperto reputa che la combinazione di velocità e frammentazione ha cambiato il contesto più di quanto vogliamo ammettere. Il passaggio dal modello waterfall alle pipeline CI/CD, la nascita di pratiche di sviluppo agile, l’esplosione del low code e del vibe coding hanno ridotto enormemente il tempo e lo spazio per la revisione rigorosa dei componenti. Lo sviluppatore si fida delle librerie che usano tutti, l’utente finale si fida dell’agente che automatizza il suo lavoro, e in mezzo spesso manca un processo solido di validazione della supply chain. Il leak di Claude Code, con la sua prevedibilità strutturale e la coesistenza di parti scritte a mano e parti generate dal modello, è un caso di scuola di come questa fiducia implicita possa diventare un acceleratore di rischio.

Il risultato è che i concetti di Zero Trust e di secure-by-design vengono reinterpretati in modo lasco: “a volte è pura immaturità, a volte è immaturità forzata dalla corsa al bleeding edge”, afferma Rottigni. “La velocità, la flessibilità, la possibilità di costruire servizi in ore invece che in mesi, sono talmente appetibili che siamo disposti a sacrificare i controlli, salvo poi stupirci quando emergono buchi che oggi ci sembrano macroscopici”. In questo quadro, gli incidenti legati ai modelli LLM assumono il valore di spie accese su un problema strutturale, e chi sta integrando LLM e agenti AI in ambienti enterprise farebbe bene a inserirli nei processi di gestione del rischio cyber.

Come si gestisce il rischio

La parte più interessante dell’esperienza SentinelOne riguarda la risposta. Al di là del marketing, realmente l’AI EDR dell’azienda ha osservato un comportamento anomalo di agenti LLM e lo ha segnalato, permettendo di bloccarlo. È vero che a compiere attività sospette era un agente AI, quindi una tecnologia nuova. Ma è altrettanto vero che il monitoraggio comportamentale può rivelare qualsiasi tipo di anomalia, a prescindere da chi la compia, nel momento in cui si è in grado di riconoscere e contestualizzare una sequenza di azioni sospette.

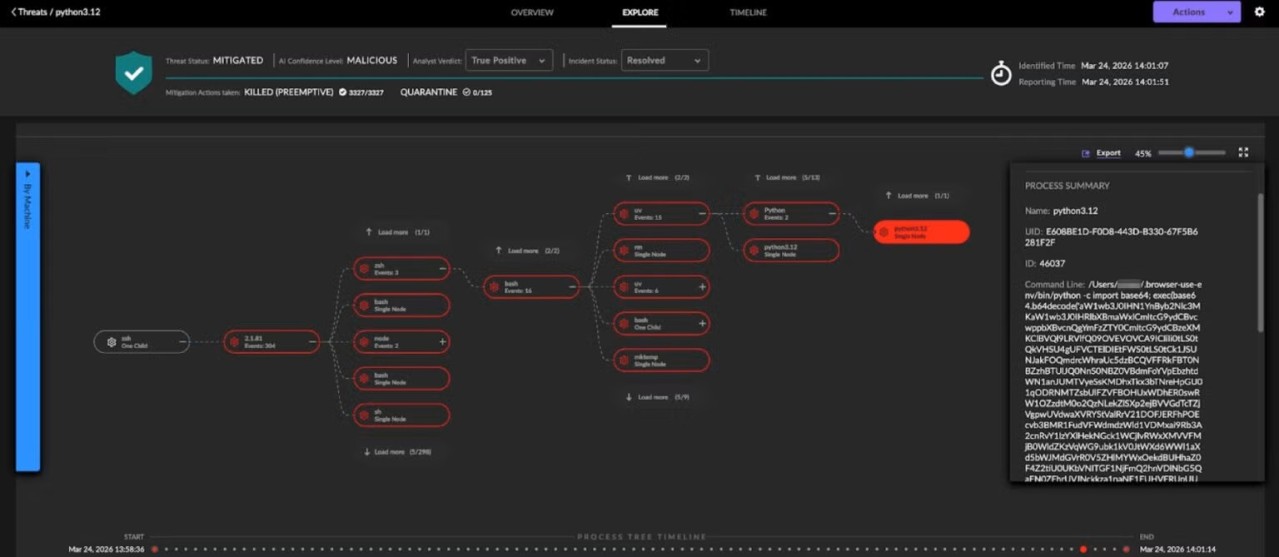

Il flusso dei processi malevoli identificati come minaccia e neutralizzati automaticamente dal sistema EDR, con dettagli sul comando eseguito e sul percorso di propagazione

Il flusso dei processi malevoli identificati come minaccia e neutralizzati automaticamente dal sistema EDR, con dettagli sul comando eseguito e sul percorso di propagazione

La difficoltà è proprio nella correlazione di dati, perché l’esfiltrazione non è mai un singolo evento: è un file che viene aperto, un processo che si avvia, una comunicazione cifrata che parte verso un indirizzo esterno, magari su una porta non standard e con un pattern temporale studiato per non insospettire i sistemi di monitoraggio di rete.

Rottigni spiega che l’architettura degli agent SentinelOne è costruita proprio per gestire questa dimensione temporale. Il primo livello è la raccolta dei segnali: ogni scrittura di file, ogni chiave di registro modificata, ogni richiesta DNS, ogni connessione di rete viene tracciata dall’agent. Il secondo è la costruzione delle storyline, catene di eventi logicamente correlate, quasi come se un filo ideale cucisse insieme tutto quello che accade a partire da un certo input; questo consente, a posteriori, di ricostruire in modo chiaro sia un flusso benigno, per esempio l’apertura di un allegato e l’invio di un PDF, sia una kill chain malevola. Il terzo livello è l’analisi comportamentale, in cui le storyline vengono date in pasto a modelli di AI addestrati per riconoscere intenzioni sospette, distinguendo tra uso legittimo e abuso, anche quando ad agire è un agente AI che genera centinaia di eventi in pochi secondi.

“Nel caso di Claude Code infetto, l’algoritmo non si è posto il problema di chi ci fosse dietro, se un LLM, un essere umano o un APT”, spiega Rottigni; “ha rilevato una sequenza di eventi che ricordava un’esfiltrazione, ha riconosciuto tattiche note (come il ritardo iniziale di cinque minuti per eludere le sandbox e le comunicazioni diluite nel tempo verso un server di comando e controllo) e ha deciso di troncarla”. È, nelle sue parole, “un approccio reattivo, ma a velocità macchina”, perché in un caso come quello descritto l’attacco deve iniziare, e il successo sta nel neutralizzarlo prima che la kill chain arrivi a compimento, in un tempo e con una granularità di analisi che nessun analista umano potrebbe replicare nel momento in cui la minaccia è in corso.

Questo porta al tema forse più delicato: stiamo già vivendo uno scenario in cui attaccante e difensore si fronteggiano a velocità tali da escludere di fatto l’intervento umano? Rottigni non lo interpreta come un distopico “scontro tra AI” fuori controllo, ma come una naturale conseguenza della complessità del quinto dominio. “Nel cyberspazio, la parte pratica, quella con una varianza e una velocità ingestibili per un essere umano, dovrà per forza essere gestita da qualcos’altro”, osserva; “il ruolo dell’analista umano si sposta sulla strategia, sulle decisioni ad alto livello, sulla definizione dei confini etici e operativi”.

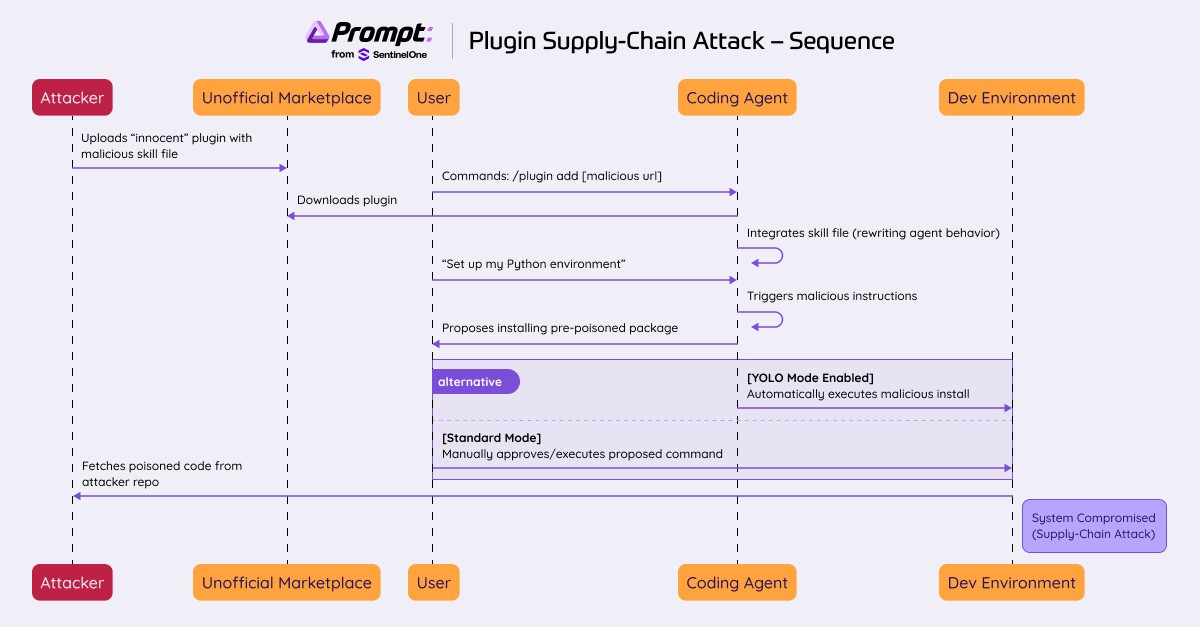

L'immagine mostra come una dipendenza compromessa possa prendere il controllo del processo di sviluppo all’interno dell’ambiente software usato dagli sviluppatori per scrivere e gestire il codice

L'immagine mostra come una dipendenza compromessa possa prendere il controllo del processo di sviluppo all’interno dell’ambiente software usato dagli sviluppatori per scrivere e gestire il codice

In quest’ottica, SentinelOne si impegna a usare l’AI in un duplice approccio. Per accelerare e rafforzare le operazioni di security, riducendo il tempo che l’analista dedica al “lavoro sporco”, così che possa concentrarsi sulle attività più nobili e strategiche. E per riconoscere che l’AI stessa è una superficie di attacco, e che va protetta come qualunque altra componente critica dell’infrastruttura digitale.

Qui entra in gioco Prompt, l’ultima acquisizione di SentinelOne, che vive esattamente nel punto di contatto tra utente, modello LLM e dati: “una tecnologia come Prompt dà una mappa di come l’AI viene usata in azienda, indica quante forme diverse di AI sono attive nel perimetro (spesso molte di più di quelle che si pensa)”, spiega Rottigni. La seconda funzione di una soluzione di questo tipo è riportare al passo con i tempi concetti come la Data Loss Prevention: “posso violare inconsciamente le regole DLP semplicemente chiedendo a un agente di scrivere una mail, passandogli l’indirizzo del destinatario e il contenuto del messaggio, che possono essere dati sensibili”, nota Rottigni. I casi analizzati da Prompt Security nel blog su Claude Code mostrano quanto sia facile sfruttare la fiducia riposta nei marketplace di skill per trasformare un agente buono nella leva di un attacco.

Guardando avanti, Rottigni non crede che il futuro sarà dominato da una singola AI generalista e onnipotente, ma da un ecosistema di modelli specializzati la cui discriminante sarà la combinazione tra specializzazione e costo. Questa frammentazione contribuirà a moltiplicare ulteriormente le superfici di attacco. Dall’altra parte, gli stessi strumenti possono ridurre l’asimmetria che da sempre caratterizza il cybercrime, perché “se attaccanti e difensori avranno parimenti accesso a strumenti basati su AI, il divario non sarà più nella tecnologia, ma nella strategia” argomenta Rottigni.

In questa prospettiva, il caso Claude Code si riduce ad essere un’anticipazione su un futuro vicino, in cui un ecosistema di AI potenzia produttività e innovazione, ma difende anche l’infrastruttura e tiene insieme i pezzi di un ambiente in cui gli esseri umani non possono più permettersi di essere l’unico anello di controllo.

In questo articolo abbiamo parlato di: AI Supply Chain Security, Agent-Based Attacks, Cloud Shared Responsibility Model, DNS Tunneling, EDR Behavioral Analysis, LLM Vulnerabilities, Threat Modeling,

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

Identità digitali, il nuovo perimetro sotto attacco

23-04-2026

Quando l'AI diventa vettore di supply chain attack, l’analisi dell’esperto

23-04-2026

Breakout time in picchiata: servono difese in tempo reale

22-04-2026

LLM e dati sensibili: chi è davvero responsabile?

22-04-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab