WEF: dati, vantaggi e guida all'adozione dell'AI nella cybersecurity

Il World Economic Forum analizza il modo in cui l'AI sta ridefinendo la difesa informatica e offre alle aziende una guida concreta per implementarla con efficacia e governance adeguata.

L'AI è diventata la principale forza di cambiamento nella cybersecurity: a dirlo è il World Economic Forum nel report Empowering Defenders: AI for Cybersecurity, redatto in collaborazione con KPMG. 20 case study reali e workshop con manager di 84 organizzazioni in 15 settori hanno contribuito a fotografare lo stato dell'adozione dell’AI, a documentarne i benefici misurabili e, soprattutto, a fornire alle organizzazioni una guida operativa per implementare l'AI nella difesa cyber con la governance necessaria.

Secondo il report, il 94% dei cyber leader identifica l'AI come il fattore di cambiamento più rilevante nel settore; il 77% delle organizzazioni la utilizza già nelle proprie operazioni di sicurezza. Chi adopera l’AI in modo estensivo ottiene diversi vantaggi, fra cui una riduzione dei costi medi di una violazione fino a 1,9 milioni di dollari e l’accorciamento di circa 80 giorni del breach lifecycle, ossia del tempo complessivo che intercorre tra l'inizio della violazione e il suo contenimento completo (inclusi tempi di detection, response e remediation).

L'88% dei team di sicurezza riferisce di un risparmio di tempo e maggiori opportunità per attività proattive. Tre casi aziendali esemplificano la portata dei risultati: KPMG ha ottenuto un incremento del 25% di efficienza operativa nell'analisi della threat intelligence; Accenture ha ridotto da 15 minuti a meno di un minuto il tempo necessario ad analizzare ciascuno dei 100.000 siti internet-facing della sua superficie di attacco; IBM, con la piattaforma ATOM, automatizza oltre 850 ore di lavoro degli analisti al mese e ha ridotto del 37% i tempi di investigazione.

Lo scenario in cui questi risultati maturano è quello di una corsa tecnologica in cui difensori e attaccanti usano l'AI per operare a velocità di macchina. Ne abbiamo discusso più volte su SecurityOpenLab quindi non vale la pena approfondire; basti ricordare che quello che richiedeva settimane di lavoro può oggi essere eseguito in minuti, abbassando le barriere tecniche e aumentando volume e impatto degli attacchi. Tuttavia, il report WEF sottolinea che l'AI non vale solo per l'automazione, ma soprattutto per amplificare la cognizione umana, accelerare il rilevamento e rafforzare la capacità di risposta su dimensioni tecniche, operative e di governance. I difensori, a differenza degli attaccanti, possono usare l'AI sui propri dati interni per ottenere una precisione contestuale che gli avversari non hanno, recuperando così un vantaggio strategico.

L'adozione però non è uniforme. Le organizzazioni più grandi, con maggiore maturità tecnica e capacità di investimento, mostrano tassi di adozione più elevati. Enti governativi, PMI e ONG restano indietro per vincoli finanziari, carenza di competenze e immaturità dei dati. Nel 2025, il 53% dei team di sicurezza riferiva di essere sottofinanziato e il 55% di essere a corto di personale; il 54% delle organizzazioni identifica la carenza di talenti qualificati come la principale barriera all'adozione. Parallelamente, il report segnala un rischio spesso sottovalutato: la dipendenza eccessiva dall'AI può erodere nel tempo l'expertise umana necessaria a intervenire quando i sistemi automatizzati falliscono. I team di sicurezza devono pertanto combinare AI e giudizio umano, simulare guasti e progettare fail-safe che mantengano operative le security operations anche in caso di interruzione degli strumenti AI.

Come adottare l'AI nella cybersecurity: la guida del WEF

La parte più operativa del report è organizzata attorno a quattro domande critiche che dirigenti e CISO devono affrontare nel percorso di adozione, corrispondenti alle altrettante fasi sequenziali di allineamento, prontezza, validazione, scaling.

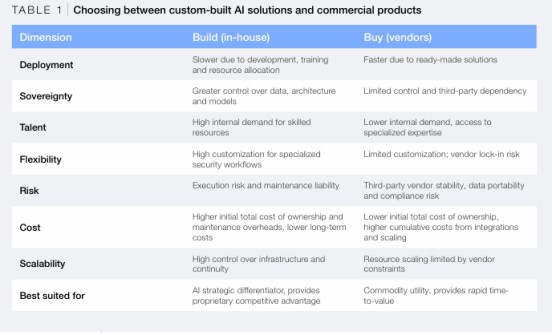

Prima ancora di investire, le aziende devono chiarire quali obiettivi di business è chiamata a supportare l'AI: resilienza operativa, compliance normativa, riduzione dei costi, fiducia dei clienti. Senza obiettivi chiari, le iniziative AI rischiano di restare scollegate dalle priorità aziendali e di non ottenere il sostegno esecutivo necessario. Il report raccomanda ai CISO di valutare prima di tutto se l'AI è davvero necessaria o se un’automazione standard possa offrire risultati equivalenti a costo e rischio inferiori. Inoltre dovrebbero comunicare con chiarezza cosa può e non può fare l’AI, quindi di tradurre i benefici in metriche comprensibili per il management, come per esempio riduzione dell'esposizione al rischio, tempi di recovery accelerati, disponibilità del servizio. Il WEF suggerisce inoltre di selezionare casi d'uso ad alto impatto per dimostrare con immediatezza il valore dell’investimento, di modo da assicurarsi il supporto della leadership prima di iniziare.

Un punto fondamentale è che l'AI rafforza la cybersecurity solo se le fondamenta sono solide. Il report identifica cinque dimensioni di readiness che i CISO devono valutare prima di procedere. La readiness dei processi: i workflow di sicurezza devono essere documentati e ripetibili, perché l'AI non può compensare l'assenza di processi stabili. La readiness tecnica e infrastrutturale: l'AI deve integrarsi senza attrito con l'architettura esistente, inclusa la gestione delle identità di macchine e agenti. La readiness dei dati: i dataset su cui opera l'AI devono essere disponibili, completi, precisi e strutturati; lacune come log storici mancanti o formati inconsistenti generano conclusioni errate, detection mancate o falsi allarmi. La readiness delle competenze: i team di sicurezza devono avere le competenze per gestire l'intero ciclo di vita dell'AI, con programmi strutturati di reskilling. La readiness della governance: devono esistere strutture e processi per supervisionare le iniziative AI, con ownership chiara, accountability e autorità decisionale definite.

Una volta svolte tutte le fasi preliminari si può passare alla validazione tramite pilot, che è essenziale per ridurre il rischio e dimostrare la fattibilità prima di un'adozione su scala aziendale. Il report raccomanda di selezionare pilot che generino benefici tangibili nel breve periodo o che affrontino obiettivi di sicurezza ad alta priorità. Ogni pilot dev’essere strutturato con tappe, criteri di successo, strategie di fallback e punti di go/no-go per abbandonare rapidamente i progetti non redditizi. È essenziale valutarli rispetto ai criteri del business case, favorire la collaborazione tra cybersecurity, IT e business per evitare che restino esperimenti isolati, e allocare risorse sufficienti per l'upskilling del personale.

Dalla teoria alla pratica

Una volta superata la fase pilota, senza monitoraggio e aggiornamento continuo si rischia che i modelli perdano efficacia nel tempo. Il WEF raccomanda di sincerarsi che infrastruttura e ambienti dati possano supportare i workload AI senza rischi di sicurezza o picchi di costo; di assegnare responsabilità chiare con governance dinamica per il monitoraggio e la valutazione dei rischi in evoluzione. Inoltre, esorta a controllare le prestazioni rispetto a criteri stabiliti per apportare aggiustamenti proattivi come la ricalibrazione degli algoritmi o l'aggiornamento delle pipeline; di comunicare in modo trasparente alla leadership i progressi e le evidenze di miglioramento; e di valutare continuamente le capacità AI emergenti per identificare opportunità di ottimizzazione.

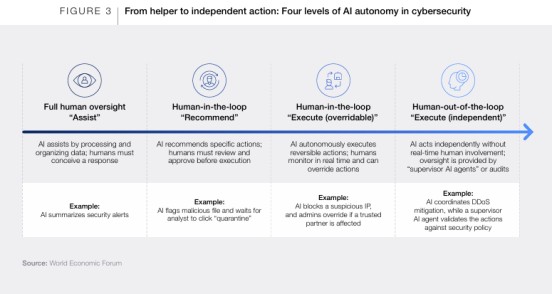

Il report dedica poi un capitolo all'AI agentica, che il WEF definisce come la transizione da strumenti reattivi a collaboratori autonomi. L'88% delle imprese sta già investendo in AI agentica; il 92% dei technology executive considera la loro gestione una competenza non negoziabile per il workforce della cybersecurity da qui a cinque anni. Agenti specializzati collaborano su threat intelligence, vulnerability management e incident response per identificare, disturbare e contenere le minacce prima che si materializzino completamente. Gartner stima che entro il 2028, il 15% delle decisioni operative quotidiane sarà preso autonomamente da agenti AI.

L'aumento di autonomia introduce però nuovi rischi: una superficie di attacco espansa, comportamenti non intenzionali degli agenti indotti da allucinazioni o manipolazioni esterne, gap di governance legati a deployment non validati. Il WEF sottolinea che il livello di autonomia appropriato dipende da rischio e reversibilità dell'azione: alta autonomia è giustificabile per decisioni a basso rischio e reversibili, mentre la supervisione umana resta indispensabile per azioni ad alto impatto con conseguenze durature, anche a costo di una risposta più lenta.

In questo articolo abbiamo parlato di: AI Agentica, Artificial Intelligence, Automazione, Cybersecurity, Governance, Incident Response, Security Operations,

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

WEF: dati, vantaggi e guida all'adozione dell'AI nella cybersecurity

05-05-2026

L'AI come operatore offensivo: zero-day scoperti in pochi minuti

05-05-2026

Shadow AI nelle aziende: rischi e opportunità per gli MSP

05-05-2026

Microsoft Teams usato per phishing: la truffa inizia via email

05-05-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab