Shadow AI nelle aziende: rischi e opportunità per gli MSP

L'adozione non governata di strumenti di intelligenza artificiale generativa espone le PMI a furto di dati, violazioni normative e manipolazione dei workflow. Come gli MSP possono rispondere.

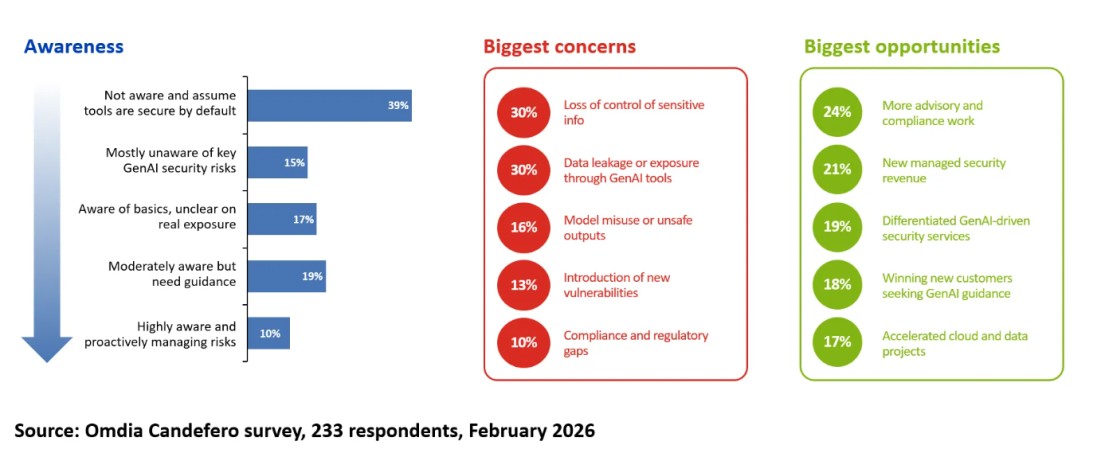

L'intelligenza artificiale generativa è ormai parte integrante dei flussi di lavoro aziendali, ma la diffusione rapida e spesso incontrollata di questi strumenti sta aprendo una superficie di rischio che molte aziende non sono ancora attrezzate a gestire. Il problema centrale è l'AI non monitorata. Quando i dipendenti utilizzano strumenti pubblici di GenAI al di fuori dei canali approvati, l'azienda perde visibilità su cosa viene condiviso e con chi. Vengono incollati dati sensibili nei prompt; la manipolazione di questi ultimi può alterare i flussi di lavoro. Le categorie di rischio principali identificate dagli esperti di settore sono tre: la shadow AI; la perdita di dati e l’esposizione di informazioni sensibili a sistemi esterni; e le minacce legate ai prompt, incluse tecniche di prompt injection capaci di manipolare il comportamento degli strumenti AI o di introdurre output pericolosi nei processi aziendali.

Per gli MSP questo scenario è sia una sfida che un'opportunità. Le PMI si rivolgono ai loro provider di riferimento cercando visibilità, controllo e protezione nell'adozione dell'AI; gli MSP, dal canto loro, possono cogliere da questo ambito nuovi ricavi da servizi gestiti, un posizionamento più solido come trusted advisor e margini di differenziazione attraverso offerte orientate alla governance della AI. È una situazione che favorisce sia i provider generalisti, che possono aggiungere servizi di AI security senza costruire una practice specializzata da zero, sia quelli già focalizzati sulla cybersecurity, che possono ampliare il portafoglio con controlli specifici per l'AI riducendo al contempo la proliferazione degli strumenti.

Per gli MSP la GenAI è una nuova opportunità per l’erogazione di servizi gestiti

Per gli MSP la GenAI è una nuova opportunità per l’erogazione di servizi gestiti

In questo contesto si inserisce il lancio di Acronis GenAI Protection, che è pensata per aiutare gli MSP a governare e proteggere l'uso della GenAI negli ambienti dei clienti PMI, senza introdurre complessità aggiuntiva o un ulteriore prodotto standalone. La soluzione si articola su tre aree operative: visibilità e monitoraggio della shadow AI, protezione dei dati sensibili nelle interazioni con gli strumenti AI, prevenzione dei prompt dannosi e degli abusi.

Gli use case coprono scenari concreti: individuare applicazioni GenAI non sanzionate negli ambienti cliente; ispezionare i prompt per rilevare la presenza di PII, PHI o dati soggetti a PCI-DSS prima che vengano trasmessi a sistemi esterni; bloccare tentativi di prompt injection sia originati dagli utenti sia provenienti da contenuti esterni che entrano in un flusso di prompt.

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Notizie correlate

Speciali Tutti gli speciali

Calendario Tutto

Ultime notizie Tutto

WEF: dati, vantaggi e guida all'adozione dell'AI nella cybersecurity

05-05-2026

L'AI come operatore offensivo: zero-day scoperti in pochi minuti

05-05-2026

Shadow AI nelle aziende: rischi e opportunità per gli MSP

05-05-2026

Microsoft Teams usato per phishing: la truffa inizia via email

05-05-2026

Redazione SecurityOpenLab

Redazione SecurityOpenLab